AICUよりニュースです!2024年にSBクリエイティブより刊行した画像生成AIの元祖ともいえる「Stable Diffusion」の解説本「画像生成AI Stable Diffusion スタートガイド」(通称・SD黄色本)の続編企画が進行中です。

本連載【AIキャラ開発スタートガイド】では、ざすこさん(道草雑草子/X@zasuko_michiksa)をゲスト著者に迎え、AI技術でオリジナルキャラクターでコンテンツ制作を行うための2026年最高の「技法書」を開発中です。今回、ついに ざすこさんの初稿完成が宣言されました!

なんとか初稿完成まで 無事走り切りました~!🙌💦

— ざすこ(道草 雑草子) (@zasuko_michiksa) May 6, 2026

気が付いたらGW最終日…😰

Stable Diffusion から Seedance2.0 まで

🔰入門者でもAIクリエイションで

オリジナルキャラクターでのコンテンツ制作が創れようになる

「技法書」として私なりに術式をまとめました👍

今後、私の Youtube… pic.twitter.com/VDsBlSBQaq

本書では「わかったつもり」になりがちな、画像生成AI・動画生成AIを、より長期に使いこなすイラストレーターやキャラクターデザイナーさんに向けた「本当に役に立つ書籍」を目指しています。

今回のブログでは、本書の3章にあたる部分から先行してコンテンツを紹介していきます。完成した書籍と見比べつつ、また美麗なグラフィックスを余すことなくお楽しみいただける"先行版"でもあります。noteサブスクリプションでは、特別なコンテンツやソースコードなどの共有やコメントなどを通したお悩み相談についても積極的に行なっていきますので、どうぞ応援よろしくお願いいたします。

https://note.com/aicu/m/mc0fcd3b9767a

StableDiffusionでAIイラストを生成しよう!

この章では、いよいよ実際に画像を生成していきます。

前章で構築した環境を使って、Stable Diffusion という生成AIツールを使ってイラストを作る方法を基礎から応用まで丁寧に解説します。

まずは、Stable Diffusionの基本を理解することから始めましょう。

StableDiffusionの基礎知識

StableDiffusionとは

Stable Diffusion(ステーブル・ディフュージョン) は、イギリスのStability AI社が開発したオープンソースの画像生成AIモデルです。2022年8月に初公開されて以降、世界中のクリエイターや多くの開発者から支持され、現在の画像生成AIブームの火付け役的な存在です。

開発元と基本情報

- 開発元: Stability AI(イギリス)

- 公開日: 2022年8月(初版)

- ライセンス: オープンソース(商用利用可能)

- 料金: 完全無料(ローカル環境で動かす場合)

最新バージョン

- Stable Diffusion XL(SDXL)1.0: 2023年7月リリース。

- 1024×1024ピクセルの高解像度画像生成に対応。

- Stable Diffusion 3.5: 2024年10月リリース。

- カスタマイズ性と生成品質の両立を実現した最新版。

※本書ではこのSDXLを中心に解説します。

アプリ?サイト?そもそも何なの?

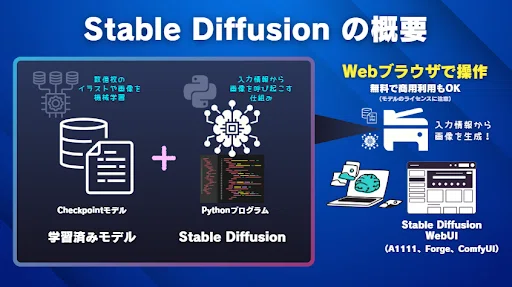

Stable Diffusion を一言で簡単に表すなら、「大量の画像データから絵の描き方を学んだAIが、指示に応じて新しい画像を一から描き出す、無料で使えるAI画像生成の仕組み」です。

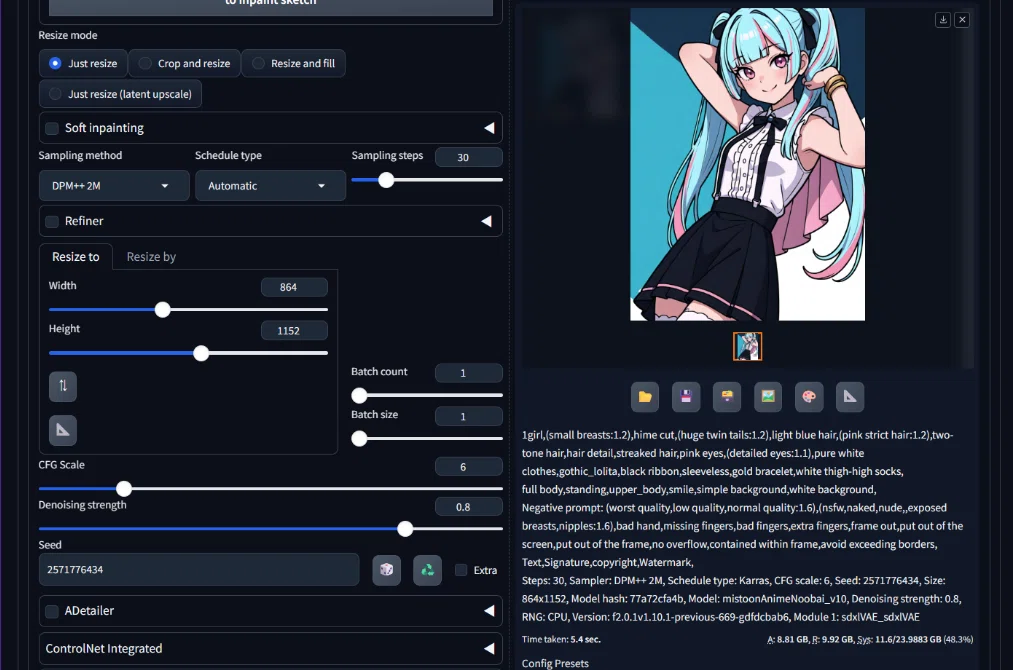

実際に使うときは、Stable Diffusion 本体の上に、A1111・Forge・ComfyUI といった操作画面(WebUI)を重ねて使います。Webブラウザで開いたその画面に、作りたい画像のイメージをテキストや数値で入力すると、画像が生成される、というのが基本的な流れです。

Stable Diffusion が画像を生成するには、数億枚ものイラストや画像を学習して作られた「学習済みモデル(Checkpointモデル)」が必要です。このモデルには「どんな指示に対してどんな絵を描けばいいか」という情報が凝縮して詰め込まれていて、いわばAIの脳みそのような役割を果たしています。

もっと簡単に例えるなら、何百万枚もの絵を見て絵の描き方を学んだ「指示を受けてゼロから絵を描くAI画家」のようなものです。コピーや複製ではなく、指示をもとに毎回新しい絵を生み出している点が大きな特徴です。

Stable Diffusion では、以下のような多彩な画像生成が可能ですので、その様々な生成機能についてひとつずつ解説していきます。

StableDiffusionで出来ること

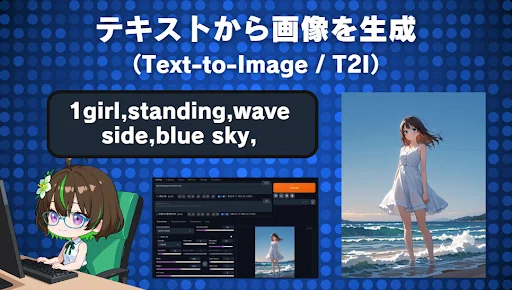

テキストから画像を生成(Text-to-Image / T2I)

テキストで書いた指示(プロンプト)をもとに、AIが自動で画像を生成する機能です。「青空の海辺に立つ少女」のような文章を入力するだけで、AIがそのイメージを絵として描き上げてくれます。この生成方法が様々な生成クリエイティブの基礎になってきます。

まずは、このテキストからの生成が使いこなせるようになると、自分の頭の中にあるイメージをAIに伝えるだけで、まるで専属のイラストレーターが描いてくれるような感覚を味わえます。

プロンプトの書き方を少し工夫するだけで生成結果が大きく変わるため、コツをつかんでいくのが最初の楽しみのひとつでもあります。

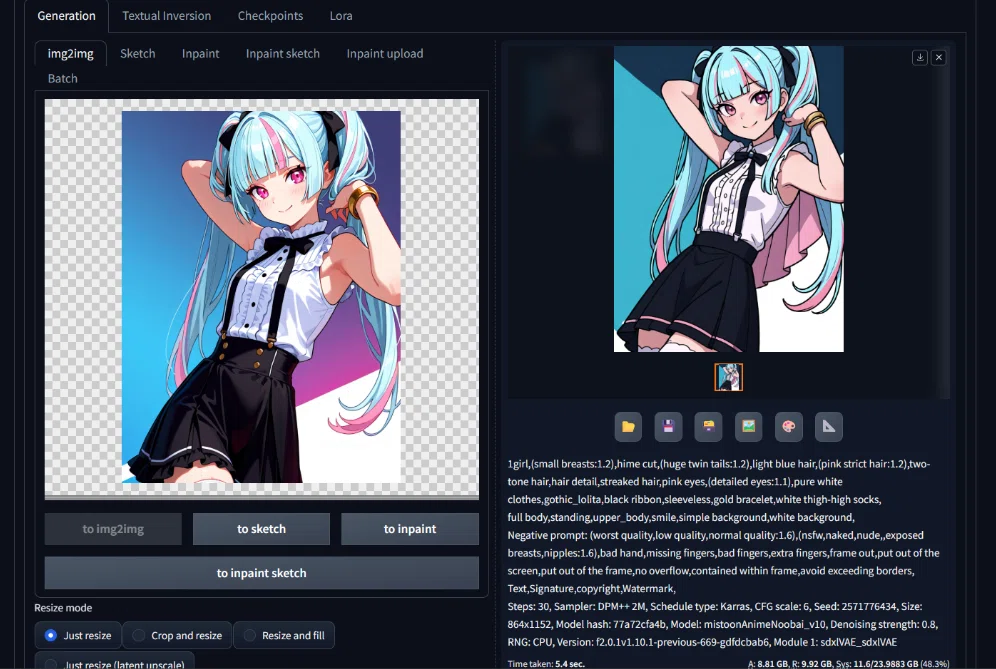

画像から画像を生成(Image-to-Image / I2I)

手持ちの画像や写真をもとに、AIが雰囲気・描画スタイル・細部の表現を変えながら新しい画像を生成する機能です。たとえば手描きのラフスケッチや撮影した写真などをアップロードすれば、それを下絵にした本格的なイラストを生成することができます。

「完全にゼロから作るのは難しい…」というときでも、大まかな構図だけ手描きで用意しておけば、あとはAIが肉付けしてくれるので、初心者でも取り組みやすいのが大きな魅力です。

元画像からどのくらい変化させるかを「ノイズ強度(デノイズ強度)」で調整できるため、ほんの少し雰囲気を変えたいときから大胆にスタイルを変えたいときまで、幅広い用途に使えます。

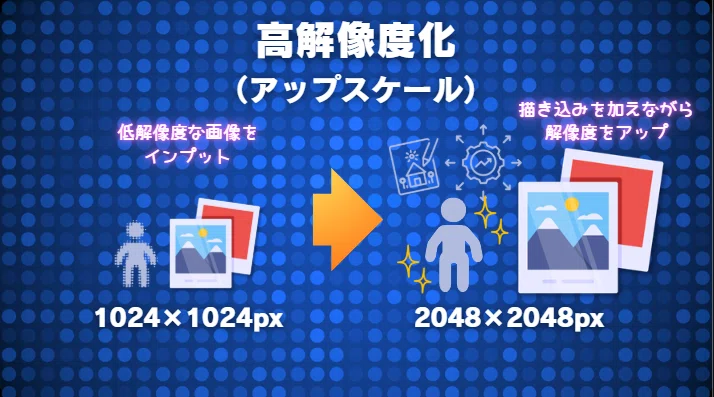

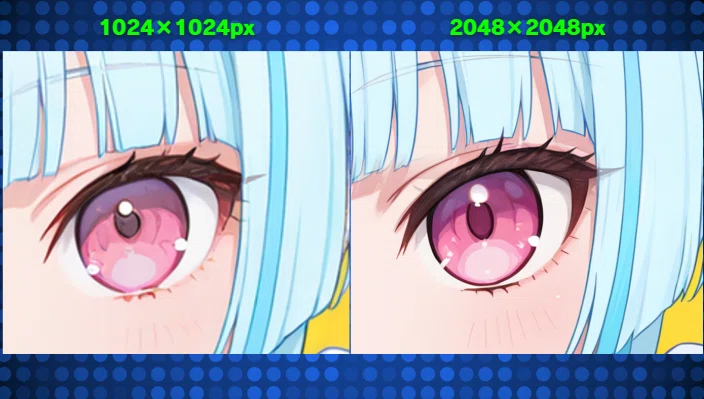

高解像度化(アップスケール)

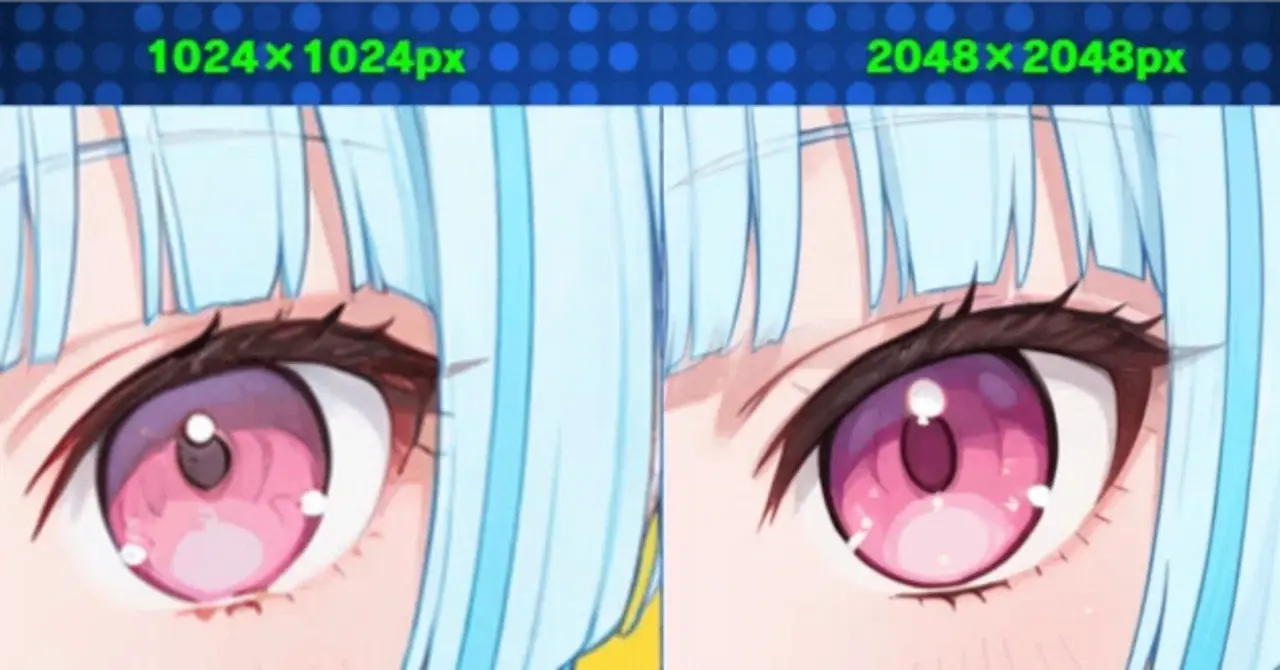

生成した画像を、細部の質感を保ちながら大きなサイズに引き伸ばす機能です。通常の画像編集ソフトで拡大するとぼやけてしまいますが、AIのアップスケールは輪郭や細部を賢く補完してくれるため、仕上がりがきれいなままサイズを上げることができます。

SNS投稿用の小さな画像を印刷物サイズにしたいときや、もう少し細かいディテールを出したいときにも活躍します。また、アップスケールと同時に細かなディテールを追加描画する「ハイレゾフィックス(Hires. fix)」機能を使うと、さらにクオリティの高い仕上がりが得られます。

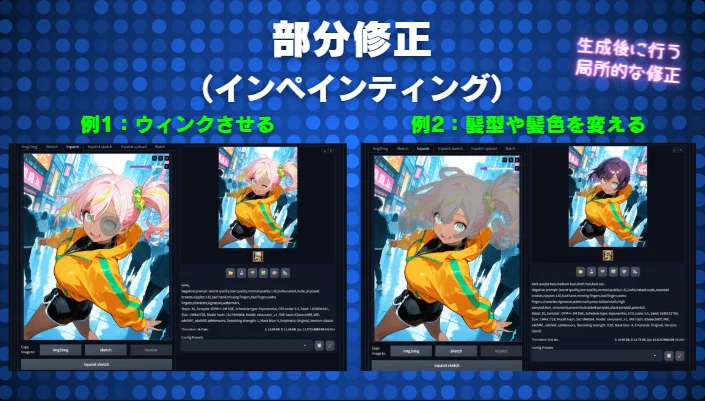

部分修正(インペインティング)

生成した画像の気になる部分だけを選択して、AIに描き直させる機能です。人物の表情がイメージと違った、背景に余計なものが写り込んでしまった、といった場合でも、その部分だけをマスク(選択)して修正できるため、一から作り直す必要がありません。

ちょうど「消しゴムで消して、また別の絵を書いてもらう」ようなイメージです。後述する「Adetailer」という拡張機能を使えば、顔や手といったよく崩れがちな部分を自動的に検出して修正することもできるため、仕上がりのクオリティが格段に上がります。

描画スタイルのカスタマイズ

ある画像の構図や内容を保ちながら、別の絵柄やタッチに変換する機能です。たとえば写真をアニメ調のイラストに変えたり、ピクセルアート風のタッチに変換したりと、元の内容はそのままでテイストだけを大きく変えることができます。

「構図はそのままで雰囲気だけ変えたい」という用途に特に向いており、何パターンものスタイルを試しながら好みの一枚を探す楽しさがあります。I2I(Image-to-Image)でモデル(チェックポイント)を変えて生成してみたり、T2I(Text-to-Image)モデルを変えるだけでも画風が大きく変わるため、様々なモデルを試し、自分の好みのスタイルを見つけてみて下さい。

続きはまた明日!

Stable Diffusion ができないこと・苦手なこと

---

この記事の続きはこちら https://www.aicu.jp/post/260508

Originally published at note.com/aicu on May 7, 2026.

Comments