SIGGRAPH ASIA 2024が終わった翌日、2024年12月7日(土)、東京科学大学 INDESTにて、[CAiBC-DEF]国際Creative AIビジネスコンソーシアム – 開発者交流フォーラムが開催されました。

会場となった東京科学大学INDESTは東京工業大学田町キャンパスとして歴史ある場所であり、隣は付属高校があります。

会場から付属高校の運動場が見えます

ピッチ会場の様子

午前はモーニングコーヒータイム

機材の準備と交流会

機材やデモのセットアップをしながら、名刺交換、アニメーションやVTuber、AIキャラクター、動画生成についての交流が始まりました。

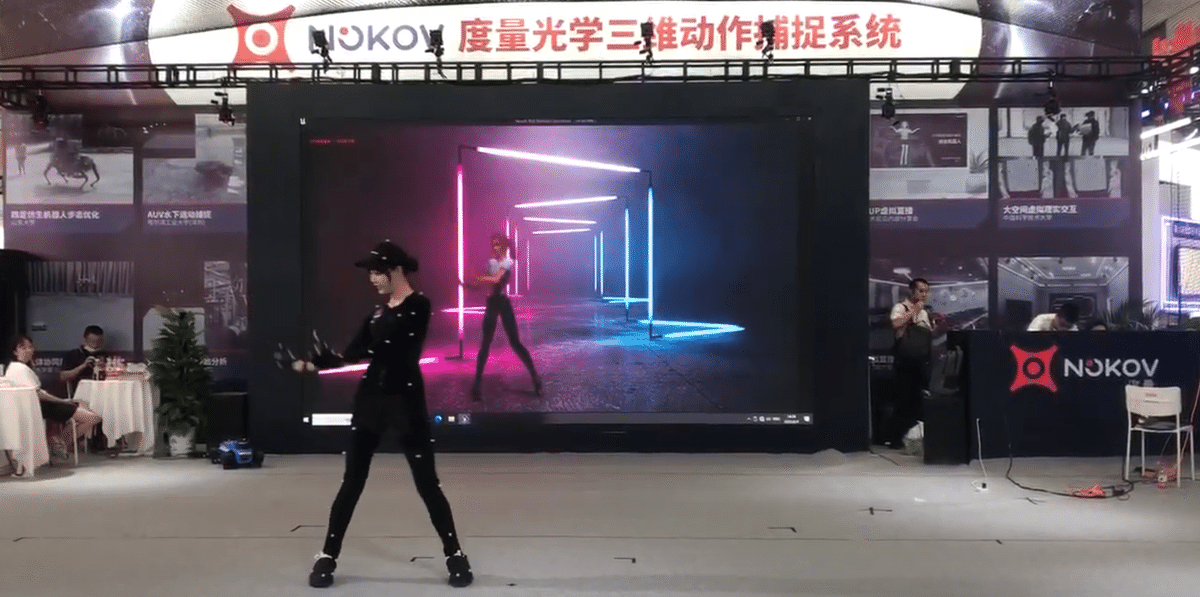

NOKOVによるハイブリッドモーションキャプチャー

マーカーレスモーションキャプチャの設営が始まりました。

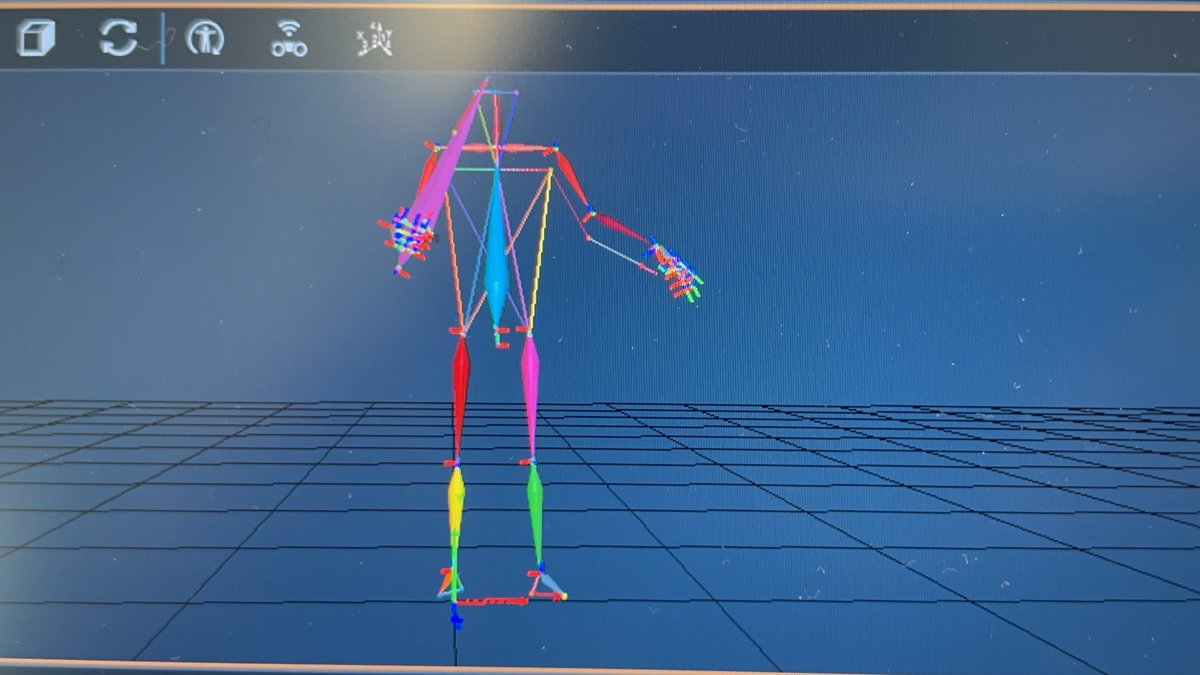

カメラは片側4台構成で、「2Dアニメーション向けのレイアウト出し」を意識したセットアップになっています。写真奥のUnreal Engine上で確認できますが、これでも3D座標が撮れています。

意外とシンプルなPoEハブによる給電です。

Manusというハンドキャプチャーも装備しています。

ワンドは小道具です。こちらにのみマーカーを使っています。

ここまで30分ぐらいでセットアップされています。

キャリブレーションはマーカーを使って行います。

1台の1脚に赤外線カメラPlutoとRGBカメラがセットになっています。

マーカーレスの人物とワンドがきちんと融合しています。指もしっかり。

VTuber力を発揮するPONOTECH早野さん

デモ動画はこちら

ランチタイム!

スポンサー協賛のPONOTECH、MagoよりBENTO BOXの提供がありました。

ありがとうございます!

ピッチ大会

NOKOV

NOKOV Leiさんと、日本代理店ディテクト小嶋さん

https://www.nokov.jp/about.html

https://twitter.com/AICUai/status/1864187990484087064

今回のセットアップは

・4台のRGBカメラ+4台の赤外線カメラ(Pluto)

・マーカーレス

・2Dアニメーション向けのポーズ収録

以上を機材設営30分、キャリブレーション

・MotionBuilder + UnrealEngine = RealTime + Rec

もちろん3D高精細マーカーでの構成も可能とのことで、

詳細は日本代理店の株式会社ディテクトにお問い合わせくださいとのこと。

AICUでも積極的に開発に使っていきたい!

3Dマーカーによるデモの様子なども紹介されました

BlendAI 小宮さん

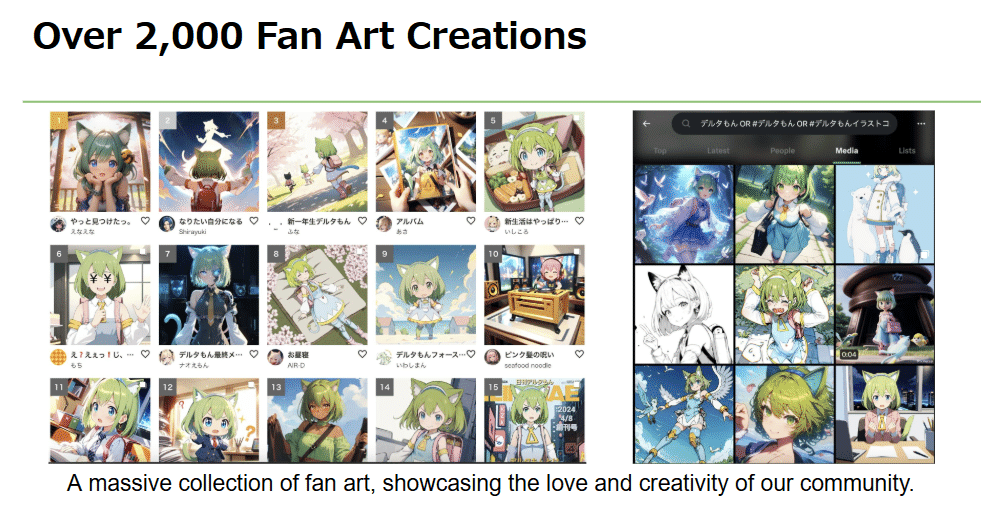

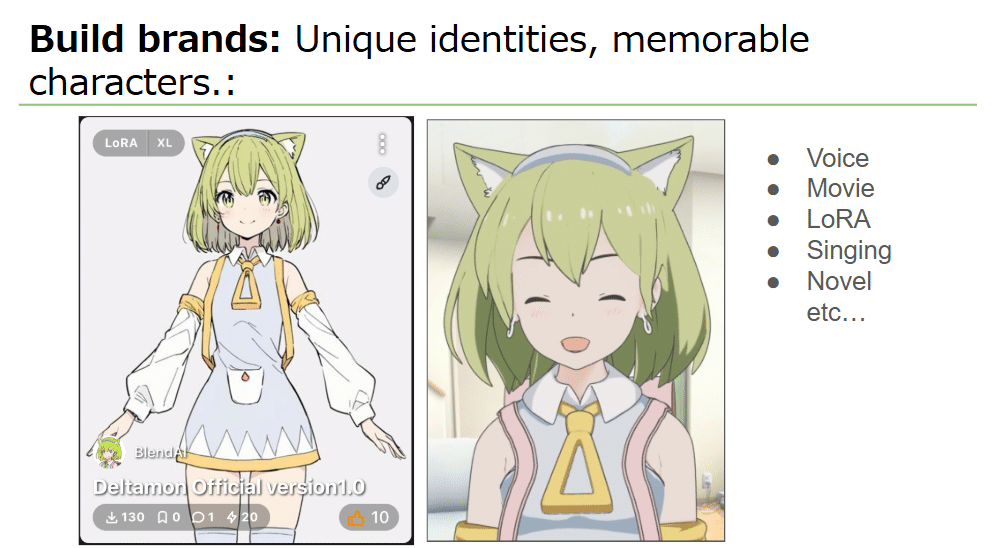

“AI-powered creation with human soul.” というスローガンとともに、 デルタもん、ガンマミィ、小説「堕天使に祝福を」 852話さん(@8co28)による美麗なイラストなども紹介がありました。

https://twitter.com/BlendAIjp/status/1864988163095302617

新キャラクターについての話題も!

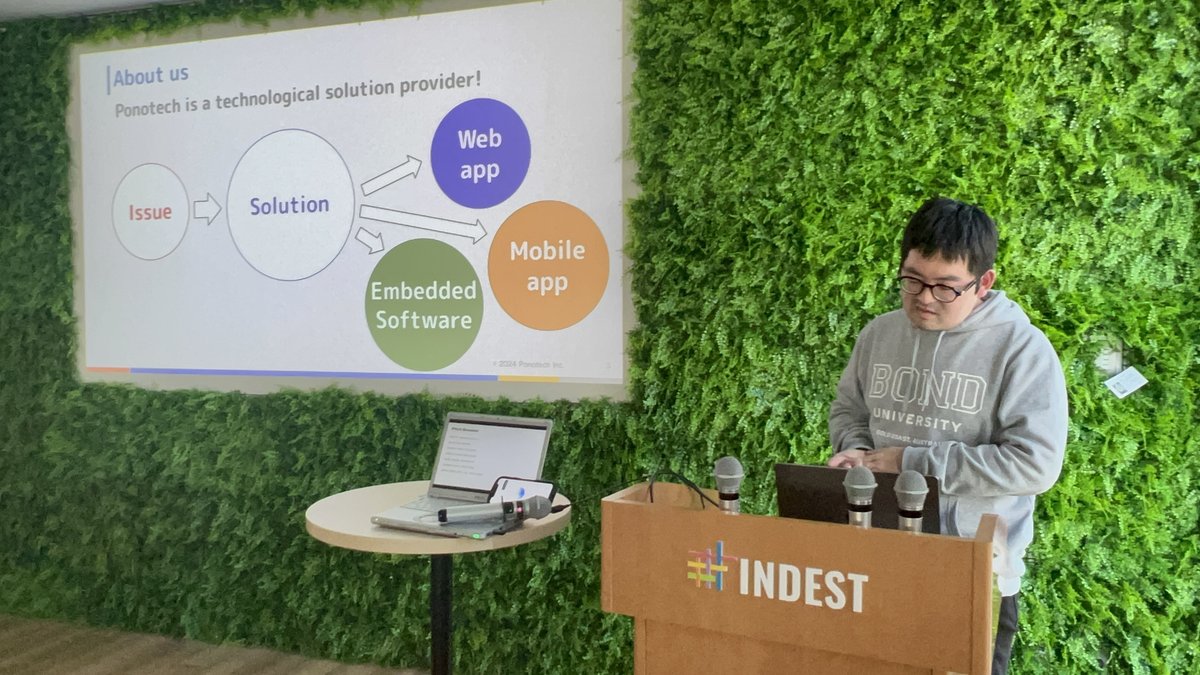

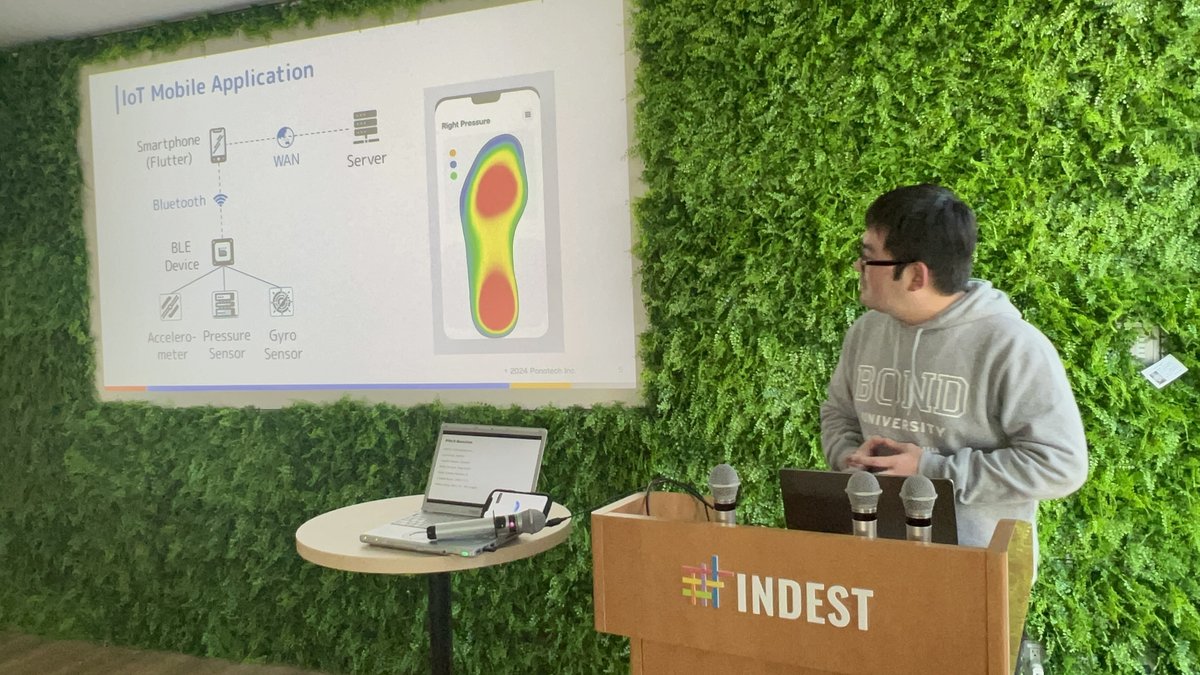

Ponotech 早野さん

ChatGPTのadvanced voice modeを使ったハイブリッドプレゼンです。

裏で動いているのは4oではないかとのこと。$20のプランでも使えますが、$200のプランにすると、その上限がなくなるようで、さっそくのデモでした。

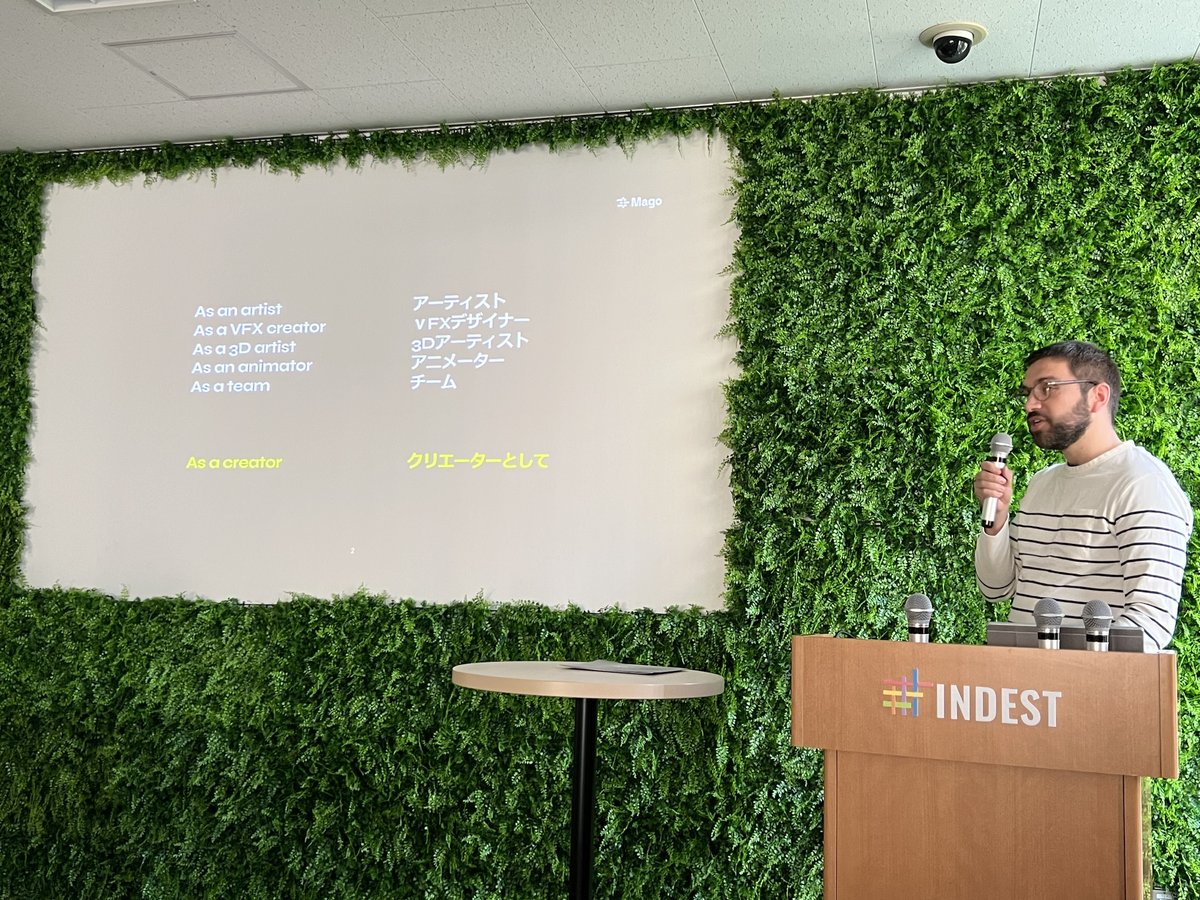

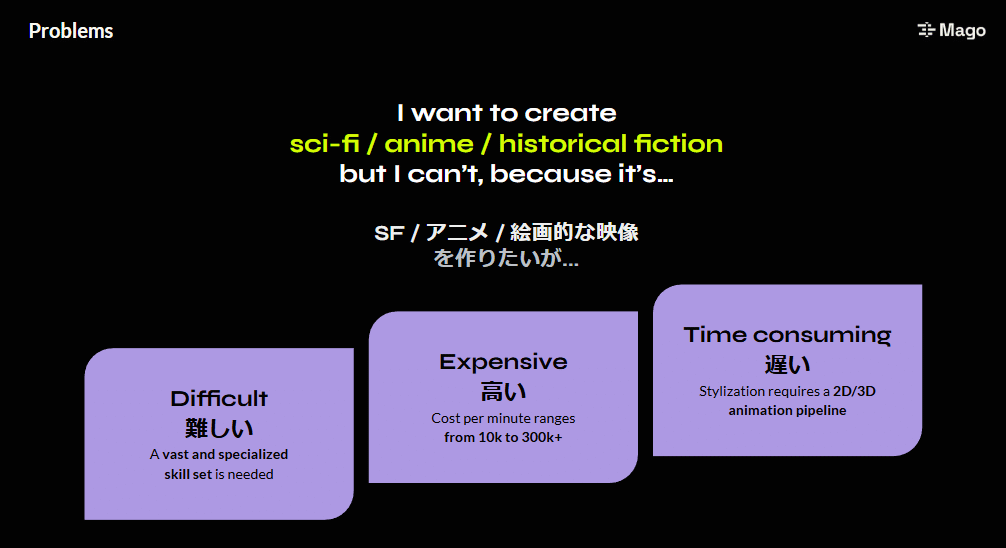

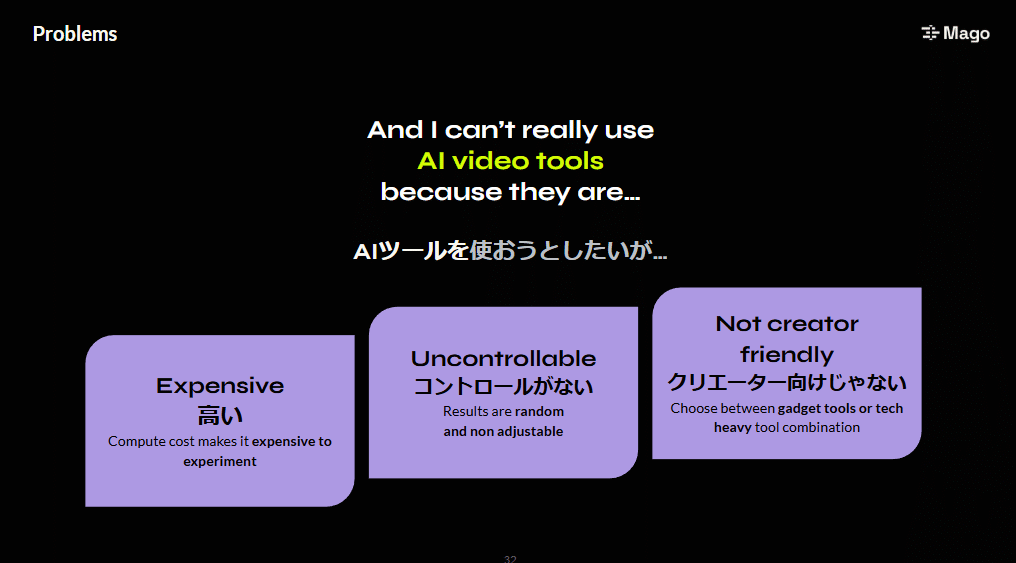

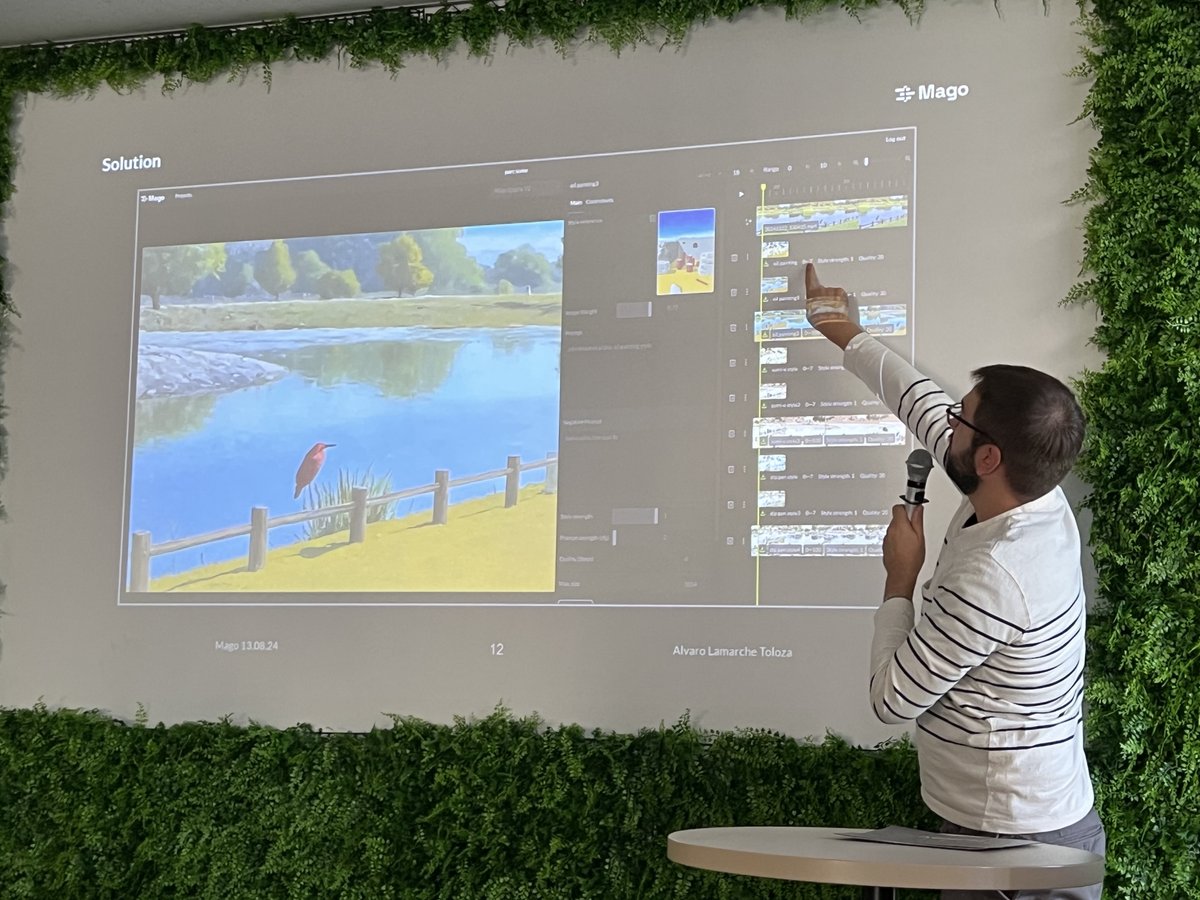

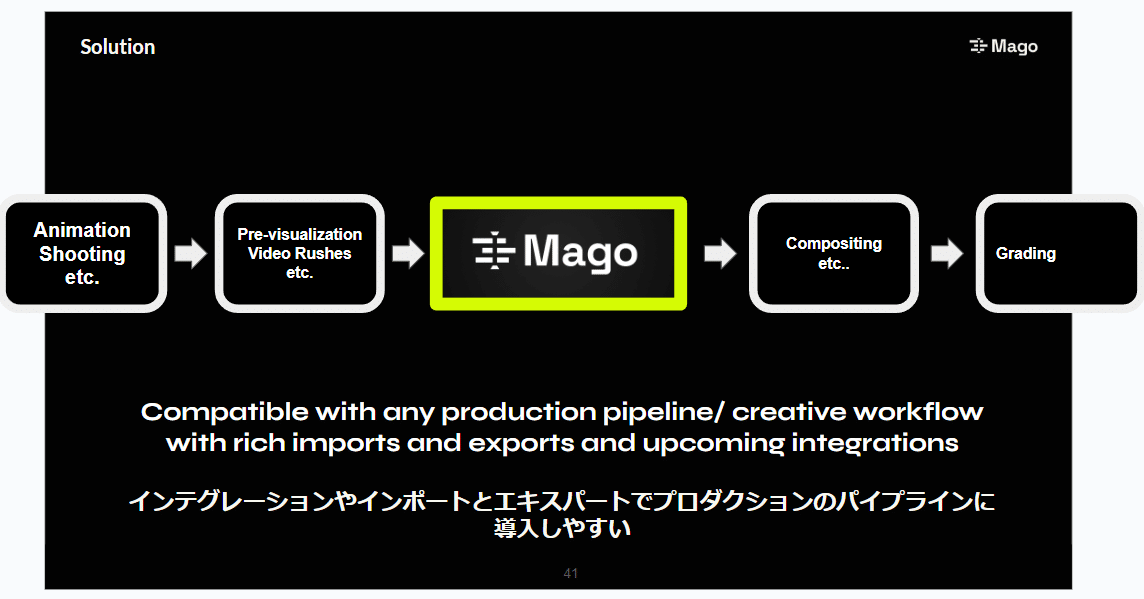

Mago アンドレ ダ・コスタさん

アーティスト、VFXデザイナー、3Dアーティスト、でもあるフランスの動画生成ツール「Mago」のクリエーター André Da Costaさん

めちゃ流暢な多言語プレゼンが見事でした。

あくまでクリエイター視点なのが興味深いです。

スタイル適用と高い一貫性。

Webによるユーザーインタフェース

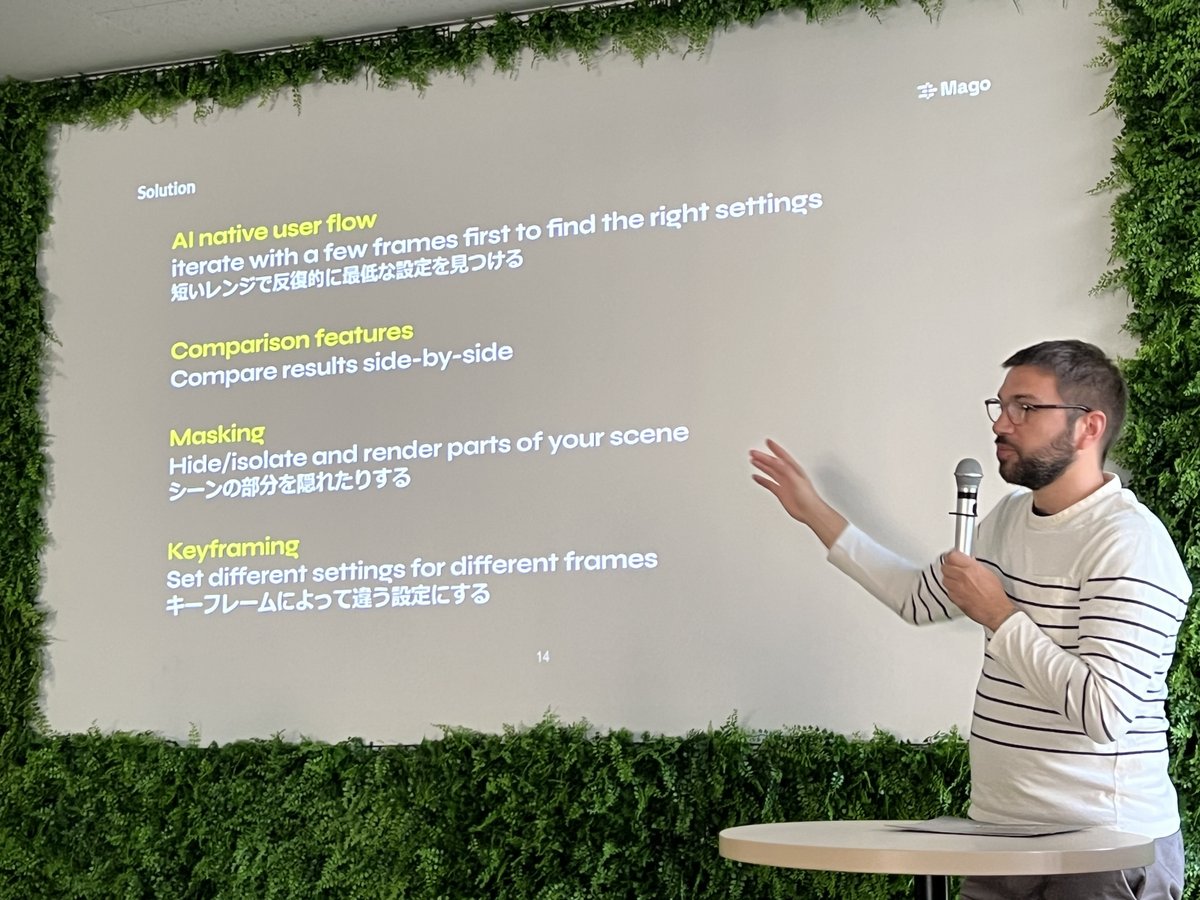

様々な機能

AI native user flow:短いレンジで反復的に最低な設定を見つける

Comparison features:結果を左右で比較

Masking:シーンの部分を隠したり分離したりする

Keyframing:キーフレームによって違う設定にする

ロードマップとしてはα版リリースが今月、来年初頭にベータリリースとのことです。Mago.Studioではウェイトリストがありますので興味のある方は登録してみては! https://www.mago.studio/

Manmaru AI よしかいさん

AI Radio Makerなどを開発する株式会社ManmaruAI 代表のよしかいさん。

AIで織りなす息づくキャラクターAIキャラクター開発の専門家として、企画から運用まで、AIキャラクター活用を包括的に支援していらっしゃいます。

「AITuberまめひなた(非公式)」についての技術紹介です。

歩いて、お散歩実況をしてくれています!

https://twitter.com/yoshikai_man/status/1865117352444276886

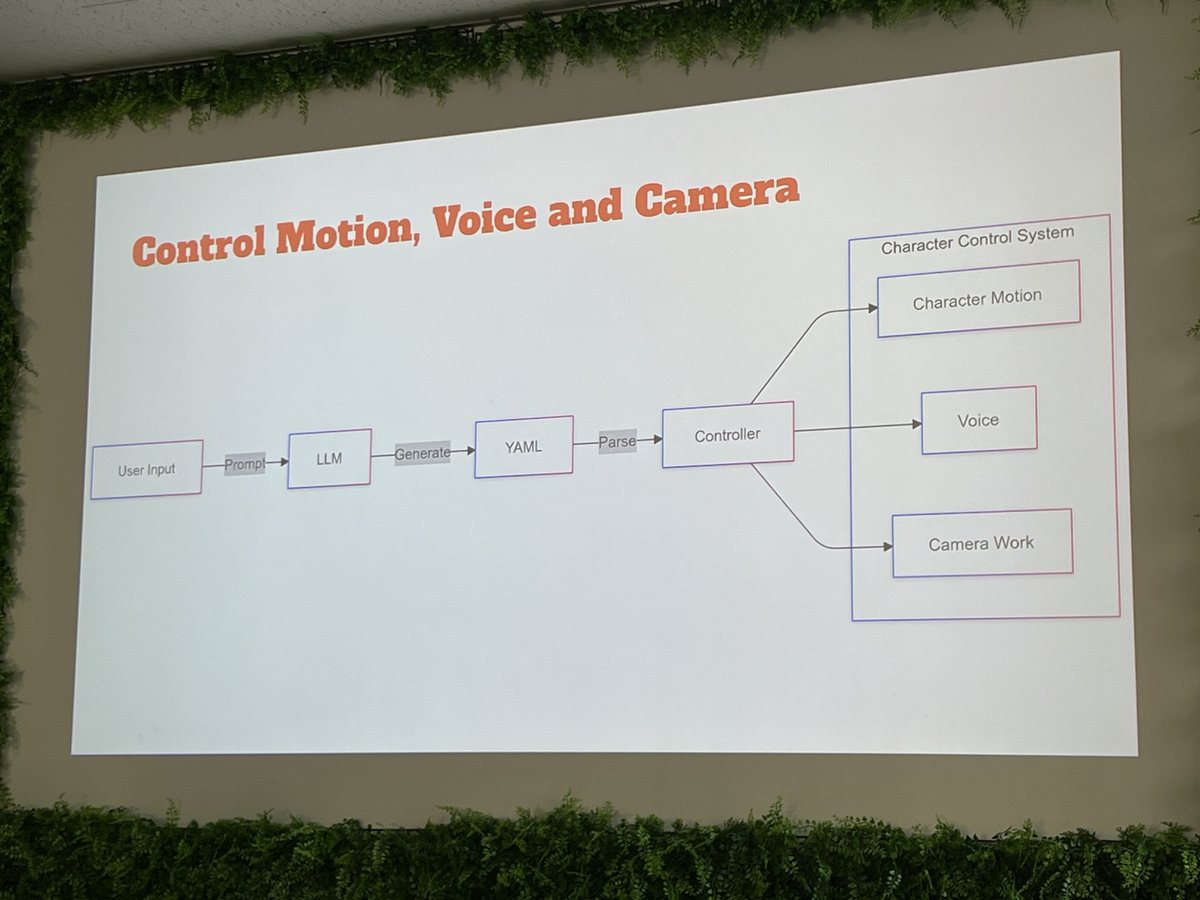

3D空間での生撮影画像を LLM に直接送ってYAMLを生成するのではなく、まずLLMにシーンのテキスト記述を生成させて、そのテキストをLLMに戻して YAML命令を生成しているそうです。この2段階のプロセスにより、精度とエラーが改善されるとのこと。

視覚による自己認識により、モデルが自分自身をよりよく認識できるようになりますが、精度はまだ 100% ではないといった技術的な課題が共有されました。

国際的なクリエイティブAIに関わる未来を感じるセッション

その後も

・アニメ制作会社 の幹部の方

これまでの絵作りと、新しい技術を使っていくうえでの課題感の共有

・AICU 代表 白井より

こちらに近いお話とセッションのまとめがありました。

https://note.com/o_ob/n/n2b00406ec07e

その後もディープなディスカッションが続くCABC-DEFでした!

次回のCABC-DEFはまだ予定されてはいませんが、来週は同じ会場「INDEST」にて国内向けにBlendAIさんと共同で忘年会が予定されています。まだ申込み受付中です!皆様の積極的なご登録をお待ちしております。

前半がAICU Japanで、SIGGRAPH ASIA 2024振り返り&AIアートバトル感想戦

https://techplay.jp/event/966307

後半がBlendAI主催の交流会になります

https://techplay.jp/event/962444

それぞれお申し込みください!

Originally published at https://note.com on Dec 8, 2024.

Comments