単語や文章から画像を生成(T2I)

生成環境構築と、必要ファイルの格納、WebUIの起動までができましたら

いよいよテキストから画像を生成(Text to Image / T2I) してみましょう!

Stable Diffusion の最も基本的な機能である「テキストから画像を生成(Text to Image / T2I)」を実際に体験してみましょう。「どんな言葉を入力すればいいの?」「設定はどこをどう変えれば?」という疑問にひとつずつ答えながら進めていきますいわば"保存版"です!ゆっくり読み進めてみてください。

これまでの連載はこちら https://j.aicu.jp/CSG

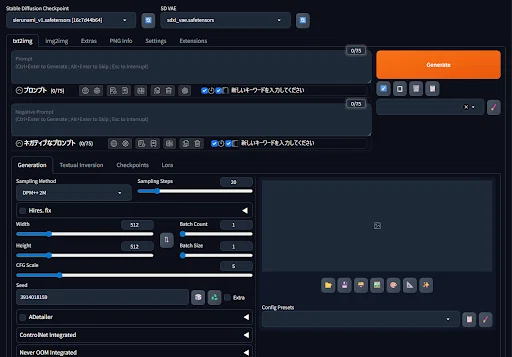

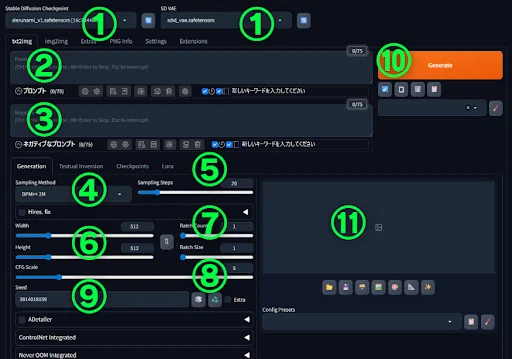

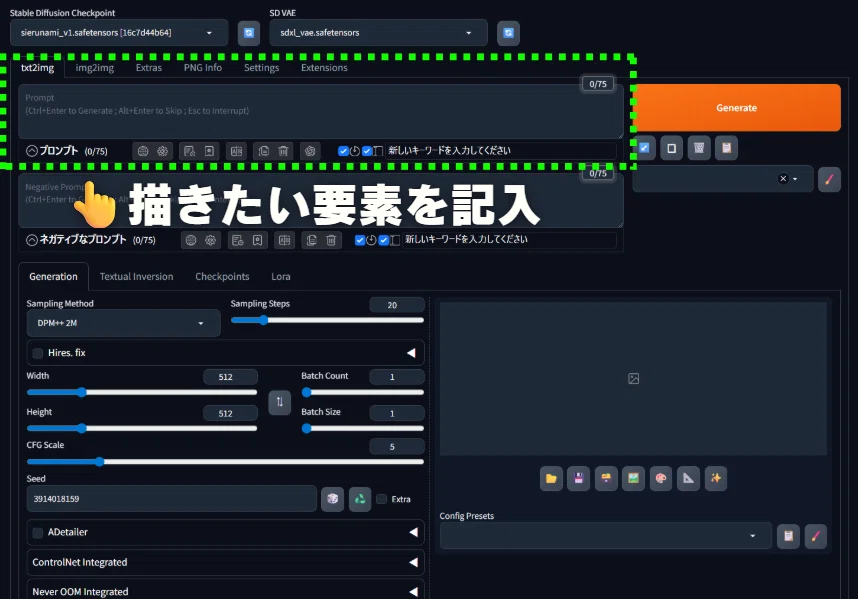

WebUIの基本画面と表示物

Forge WebUIを起動すると、最初に「txt2img」タブが表示されます。これがテキストから画像を生成するメイン画面です。画面上にはさまざまな入力欄や設定項目が並んでいて、最初は少し圧倒されるかもしれませんが、実際に使うのはそのうちのほんの一部です。

まずは各エリアの役割を大まかに把握しておきましょう。

txt2img画面の構成

各エリアの説明

①モデル設定:

役割 Checkpoint、VAEを設定

入力内容 ダウンロード済のものから選択

②プロンプト入力欄

役割 生成したい画像の内容を記述

入力内容 英単語または文章(例:1girl, standing, smile)

③ネガティブプロンプト

役割 生成したくない要素を記述

入力内容 英単語(例:low quality, bad hands)

④Sampling method

役割 サンプリング方法(生成アルゴリズム)

入力内容 PM++ 2M Karras など

⑤Sampling steps

役割 生成ステップ数(多いほど高品質)

入力内容 実質的な上限あり、20〜30推奨

⑥Width / Height

役割 生成画像の横幅・高さ

入力内容 1024×1024(SDXL推奨)

⑦Batch count

役割 生成回数

入力内容 1〜(一度に何枚生成するか)

⑧CFG Scale

役割 プロンプトへの忠実度

入力内容 モデル毎に適正変化、7〜9推奨

⑨Seed

役割 乱数シード値(再現性)

入力内容 -1(ランダム)または固定値

⑩Generate ボタン

役割 画像生成を実行

入力内容 クリックで生成開始

⑪生成結果表示エリア

役割 生成された画像が表示される

入力内容 画像クリックで拡大表示

基本的な使い方

では、実際に画像を生成してみましょう。手順は大きく6つのステップに分かれていますが、難しいことは何もありません。

最初はシンプルな設定でさっと一枚生成してみることが、一番の近道です。

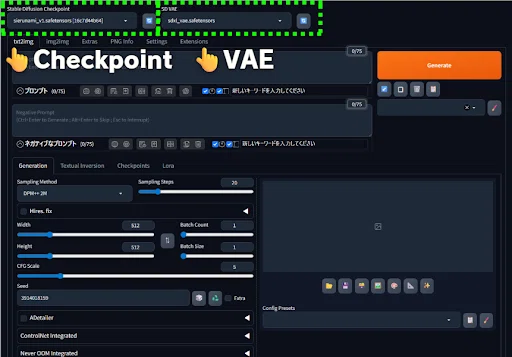

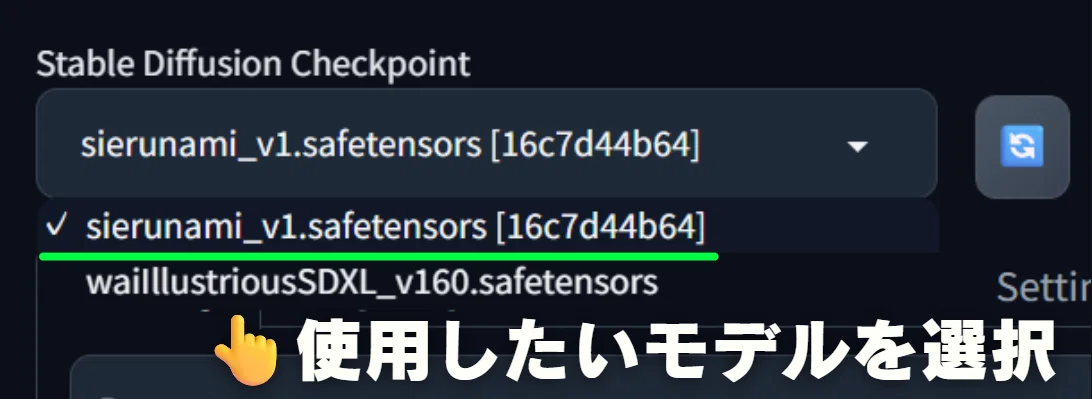

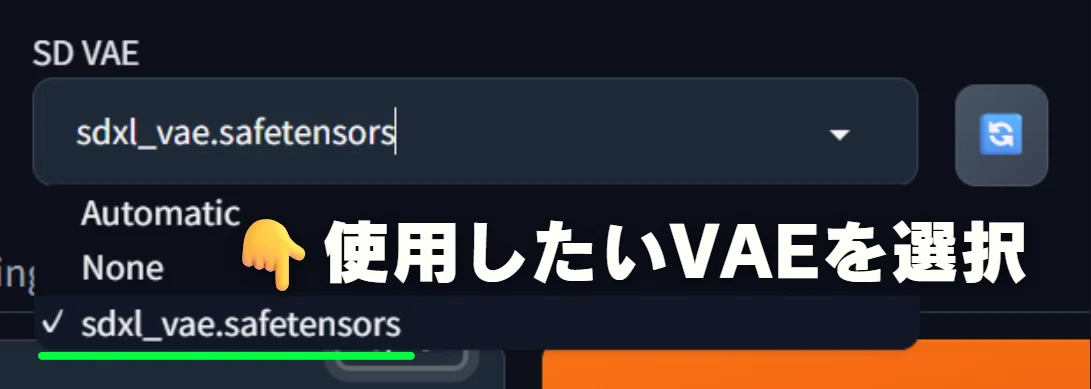

ステップ1:CheckpointモデルとVAEを設定

まず、入力欄(①)に生成で使用したいCheckpointモデルとVAEを選択します。Checkpointモデルは「AIの画風・スタイルを決める脳みそ」のようなもので、ここで選ぶモデルによって生成される絵柄の雰囲気がガラッと変わります。

選択項目にモデル名が表示されない場合は右側のリロードボタンを押すか、正しい場所にそれぞれのモデルが格納されているか確認してください。

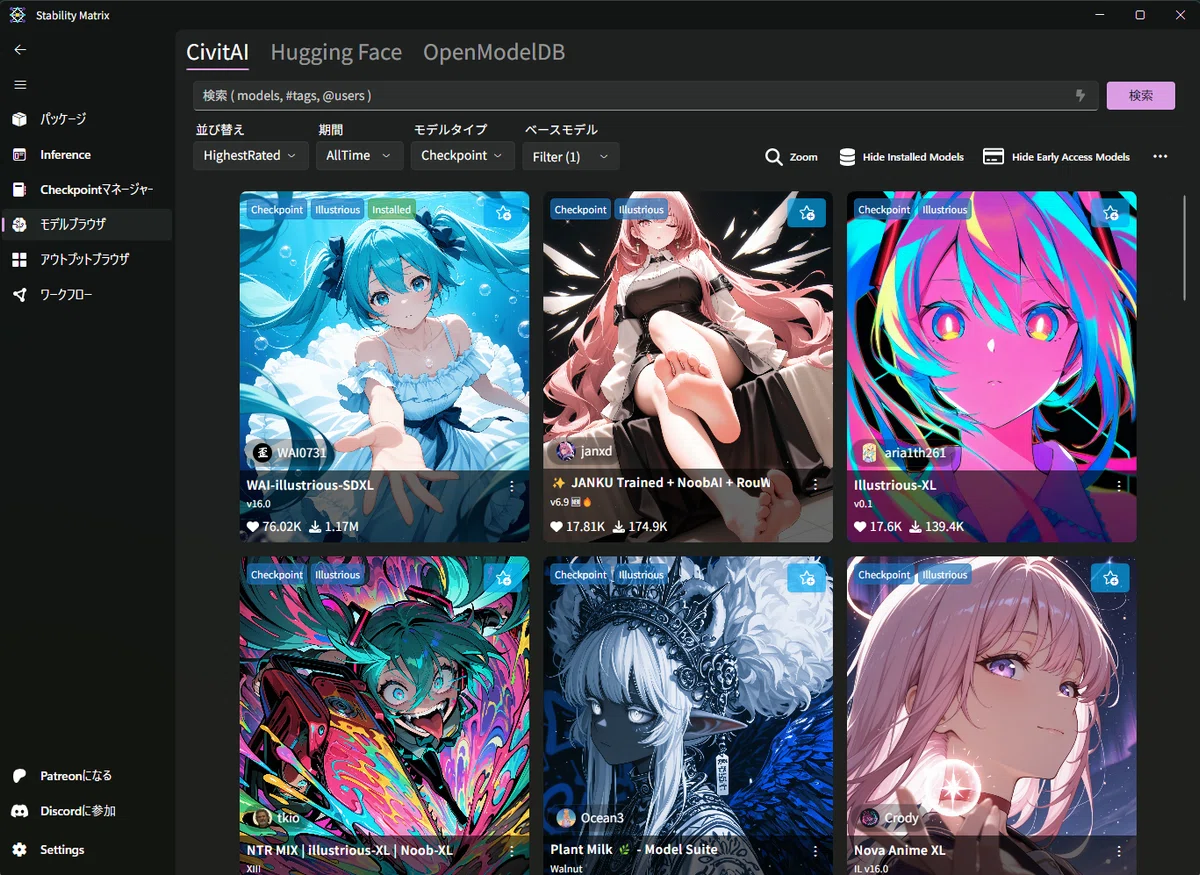

おススメのCheckpointモデル

イラスト系で入門者の方へもおススメできるCheckpointモデルは以下のモデルです。

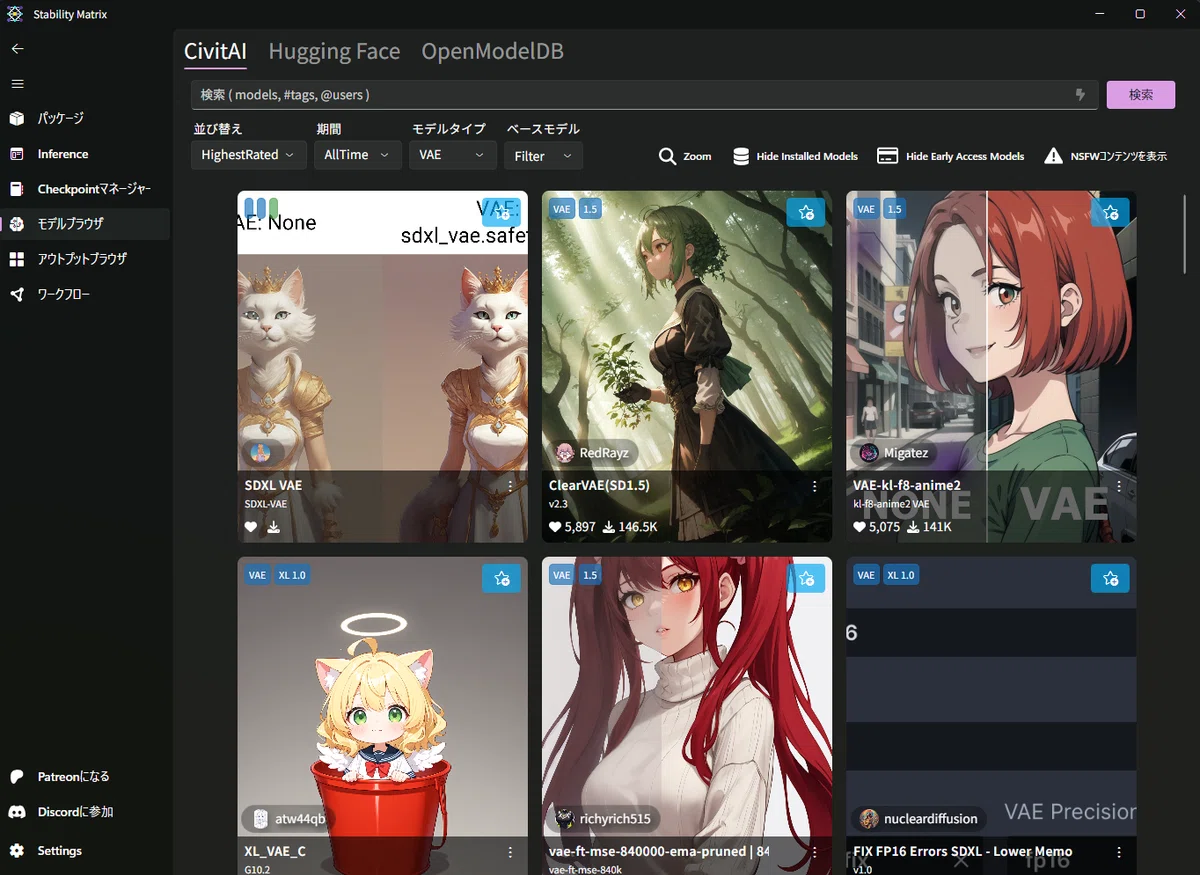

VAEモデルと併せてStability Matrix のモデルブラウザやCivitaiのページからモデルをダウンロードし下記のフォルダに保存しておきましょう。

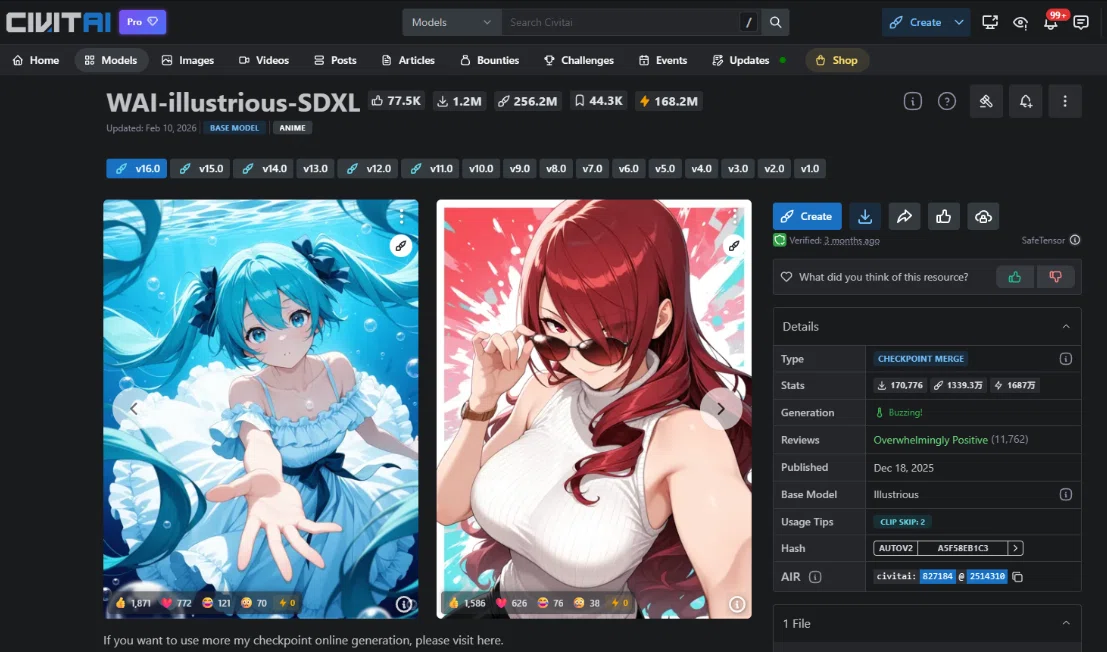

WAI-illustrious-SDXL:

生成結果の特徴 Stable Diffusion XL系の「Illustratrious-XL」という

手や指などの破綻も少なく良質なモデルの改良版で

非常に品質的にバランスの良いイラストが生成可能

Civitaiのリポジトリ https://civitai.com/models/827184

Sierunami:

生成結果の特徴 Stable Diffusion XL系の「Illustratrious-XL」の改良版

柔らかい輪郭と塗りイラスト的な表現が特徴的

Civitaiのリポジトリ https://civitai.com/models/1048343/sierunami

Mistoon_Anime:

生成結果の特徴 Stable Diffusion XL系の「Illustratrious-XL」の改良版

ハッキリとした輪郭とフラットな塗りの

アニメ的表現が特徴的

Civitaiのリポジトリ https://civitai.com/models/24149/mistoonanime?modelVersionId=1540184

SDXL VAE:

生成結果の特徴 Stable Diffusion XL用のVAEモデル

Civitaiのリポジトリ https://civitai.com/models/296576

モデルファイルの保存場所

📁StabilityMatrix

├── 📁Data

│ ├── 📁Models

│ │ ├── 📁StableDiffusion ← checkpointファイル

│ │ ├── 📁VAE ← VAEファイル

│ │ ├── 📁TextualInversion

│ │ ├── 📁Lora

ステップ2:プロンプトを入力

次に、生成したい画像を描くためのプロンプト(単語・文章)を、入力欄(②)に英語で入力します。プロンプトとは「AIへの指示書」のようなもので、描いてほしい内容を英単語で伝えます。

要素が複数ある場合は「,(カンマ)」で区切りながら入力してください。日本語でも一部動作しますが、英語の方がずっと精度が高いため、英語入力を基本にしましょう。

例:シンプルなプロンプト

1girl, standing, smile

意味:

- 1girl = 女の子1人

- standing = 立っている

- smile = 笑顔

ステップ3:ネガティブプロンプトを入力

プロンプトのみでも生成は可能ですが、ネガティブプロンプトを一緒に設定することで生成される画像の品質が大きく向上します。

ネガティブプロンプトとは「これは描かないで」という指示のことで、手の崩れや低画質、余計な文字の混入といった"よくある失敗"をあらかじめ防ぐことができます。

ネガティブプロンプト入力欄(③)に、生成したくない要素を入力します。

例:品質向上のためのネガティブプロンプト

worst quality,low quality, bad anatomy, bad hands,

意味:低品質な画像、手の崩れ、文字の混入、署名・透かしなどを避ける

このネガティブプロンプトについてのより詳しい説明は後の節で解説していきますので、

ここではそういったものがある、ということだけをまずは把握しておきましょう。

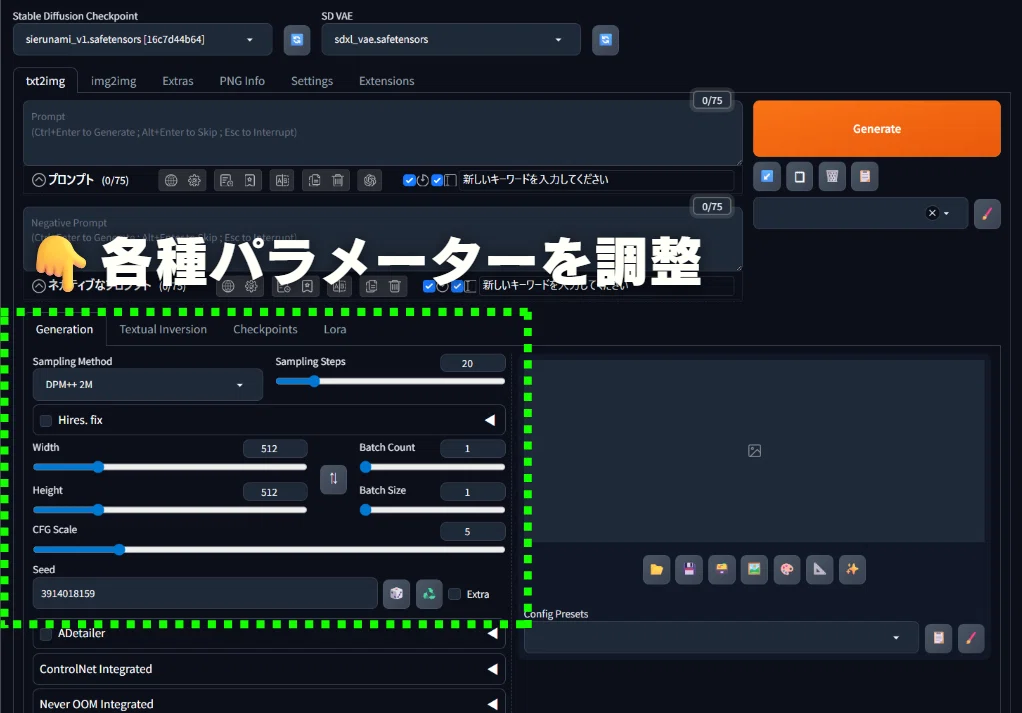

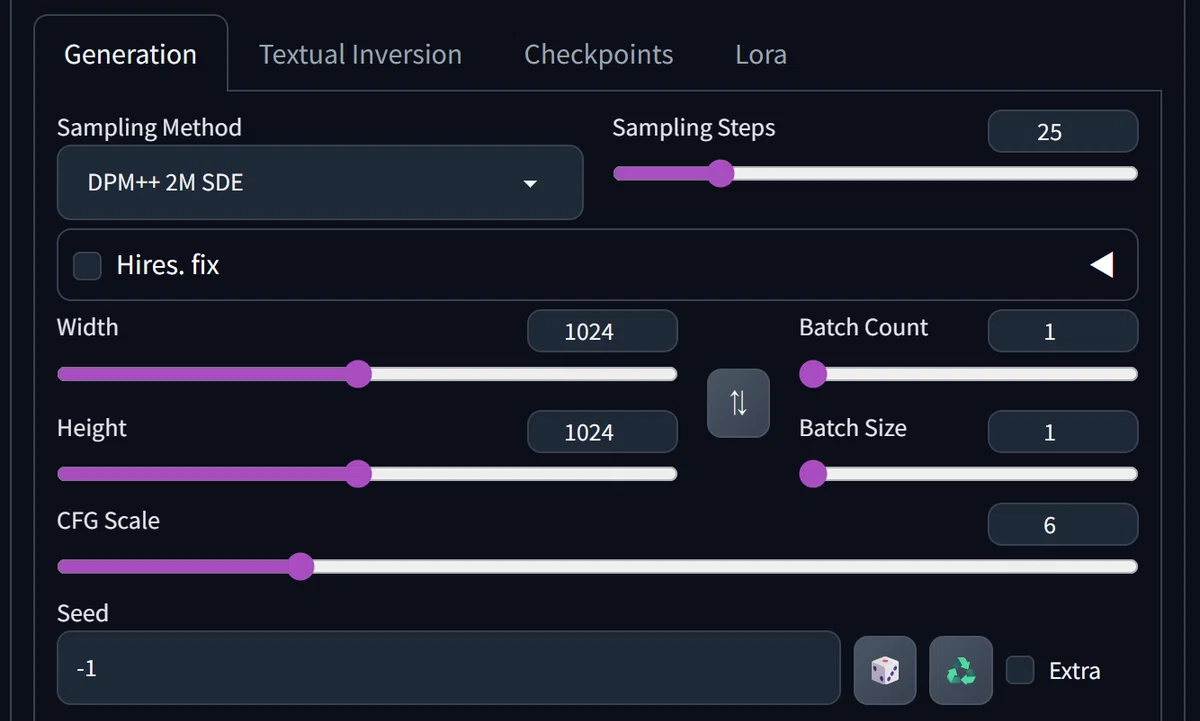

ステップ4:生成パラメータ設定を確認

プロンプトの入力が終わったら、生成の「品質」や「スタイル」を細かく調整するパラメータを確認しましょう。最初は以下の推奨設定のままで問題ありません。

慣れてきたら少しずつ変えて、結果の違いを楽しんでみてください。

基本設定を以下のように設定します(初心者向け推奨設定)

Sampling method:

推奨値 DPM++ 2M SDE

理由 バランスが良く高品質

Sampling steps:

推奨値 20〜30

理由 30くらいに上げると高品質

Width / Height:

推奨値 1024×1024

理由 SDXLの推奨解像度

Batch count:

推奨値 1

理由 最初は1枚ずつ試す

CFG Scale:

推奨値 6

理由 プロンプトへの忠実度(5〜9推奨)

Seed:

推奨値 -1

理由 ランダム生成(毎回違う画像)

ステップ5:「Generate」ボタンをクリック

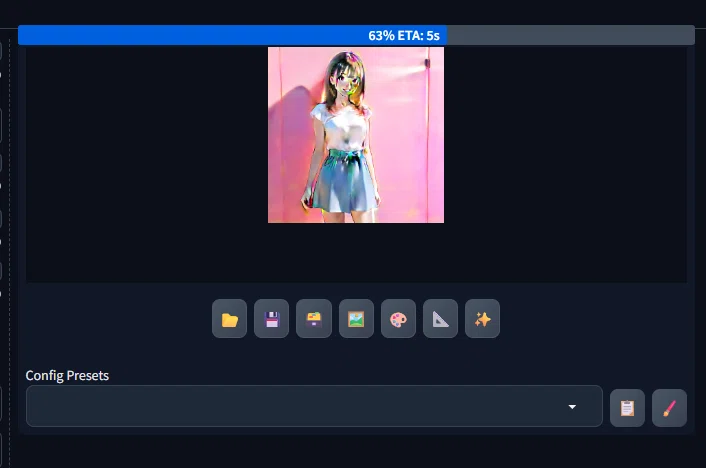

設定が整ったら、画面下部の「Generate」ボタン(⑩)をクリックして画像を生成します。生成中は進行状況バーが表示されます。

PCのスペックやステップ数によって多少変わりますが、通常は数十秒〜1分程度で完了します。生成が終わるまでは、他のボタンを不用意にクリックしないようにしておきましょう。

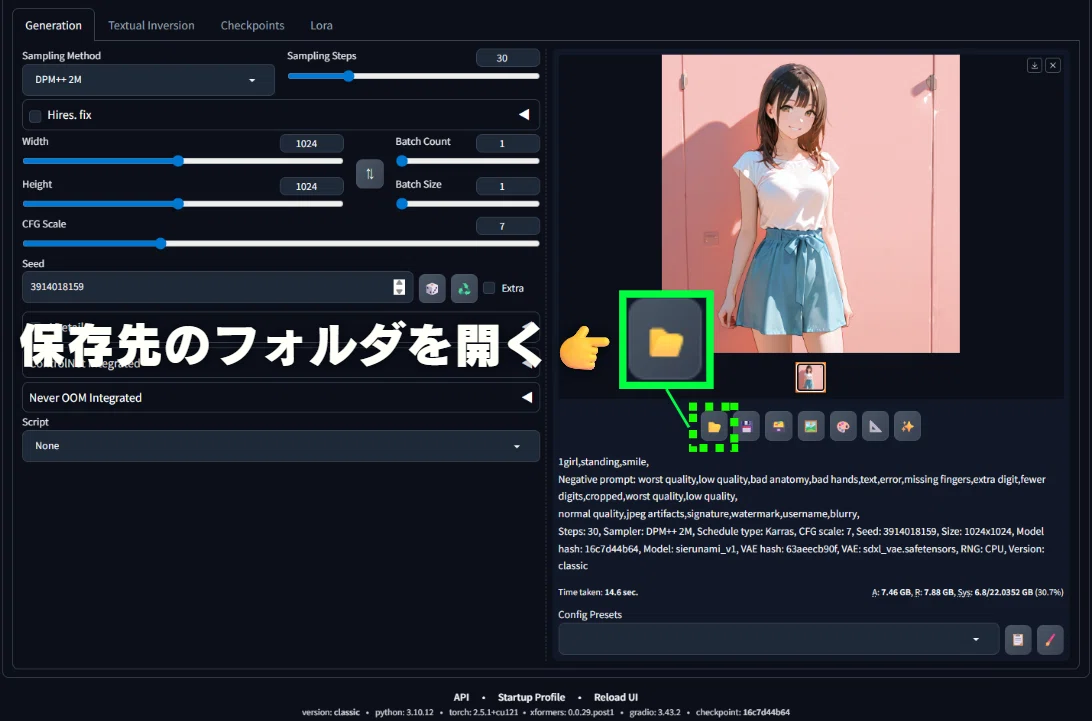

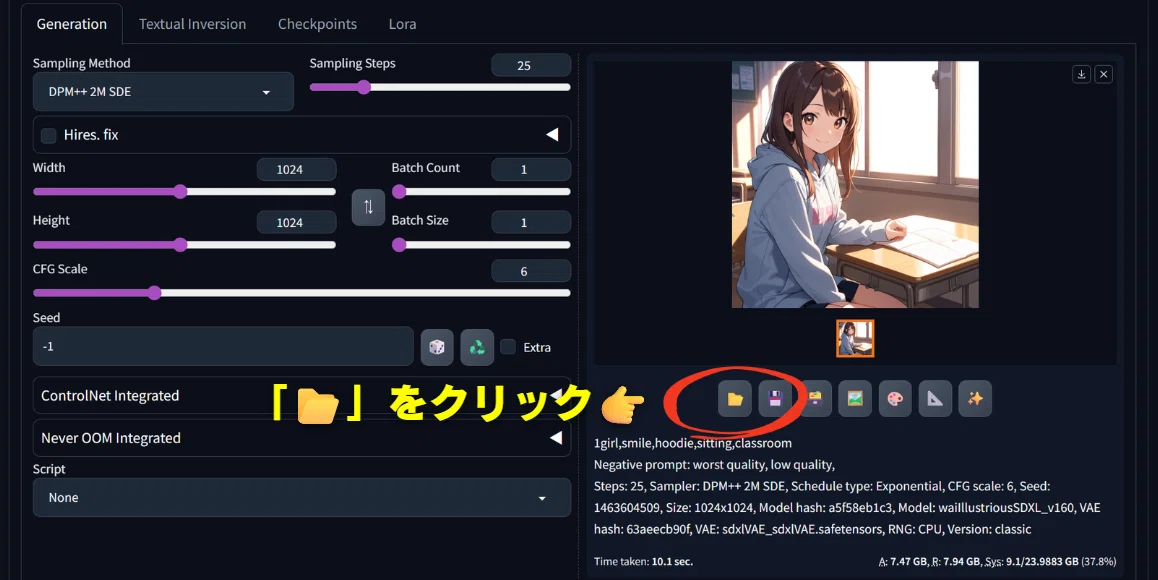

ステップ6:生成結果を確認

生成が完了すると、画面右側の生成結果表示エリア(⑪)に画像が表示されます。思い通りの絵が出てきた場合は、すぐに保存しておくことをおすすめします。

もし気に入らなければ、プロンプトを少し変えてもう一度Generateを押してみましょう。

- 画像をクリック:拡大表示

- 右クリック → 名前を付けて保存:画像を保存

- 画像下のフォルダアイコン:保存先フォルダを開く(ローカル環境の場合)

- GoogleColab(ざすこ式Notebook):連携したGoogle Driveの下記のフォルダに格納

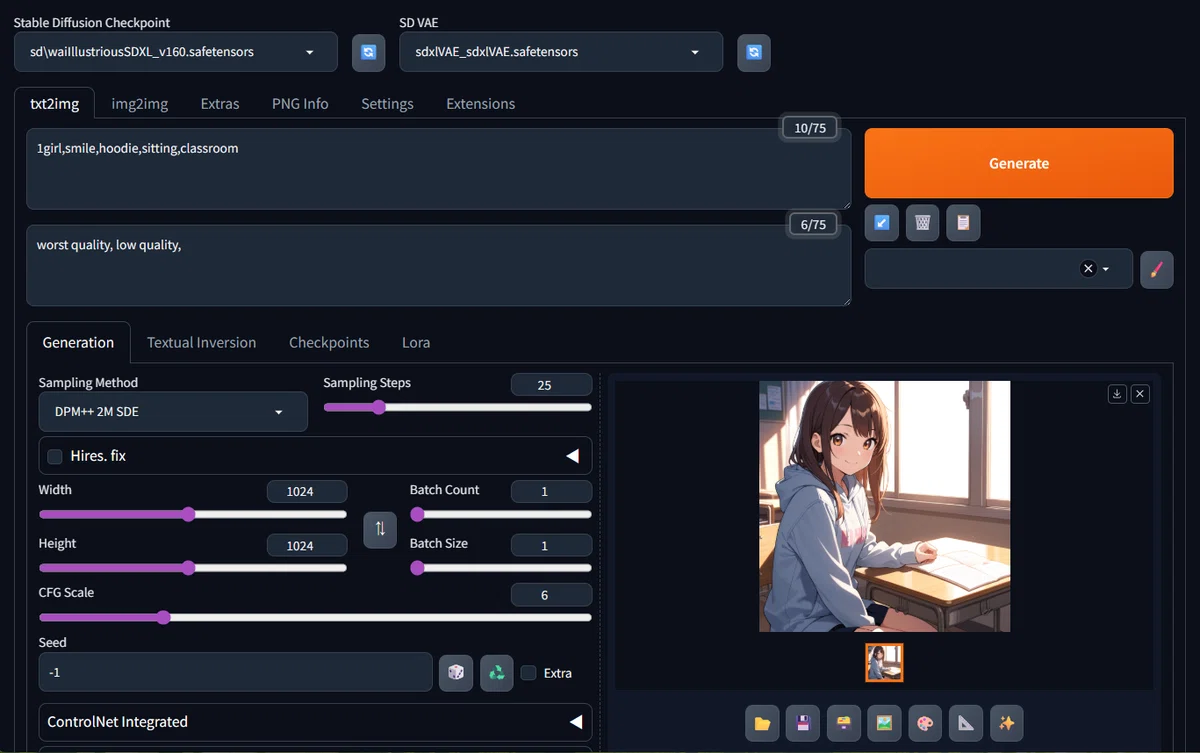

試しに生成してみよう

ここまでの設定を踏まえて、実際に一枚画像を生成してみましょう。「うまくいくかな?」と不安に思う必要はありません。

最初から完璧な絵を目指すのではなく、まずは生成できた、という体験を積み重ねることが大切です。

まずは手始めに、以下の様な基礎的で少量のテキストから画像を生成してみましょう!

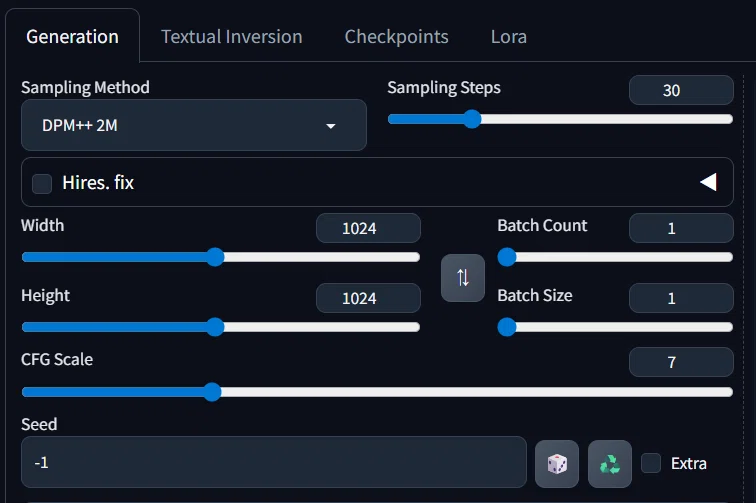

例題:パーカー姿の女の子を生成する

プロンプト:1girl,smile,hoodie,sitting,classroom

意味:

- 1girl = 女の子1人

- smile = 笑顔

- hoodie = パーカー

- sitting = 座っている

- classroom = 教室

ネガティブプロンプト:worst quality,low quality,

意味:

- worst quality = 最悪の品質

- low quality = 低品質

生成設定

項目:Sampling method

設定値:DPM++ 2M SDE

項目:Sampling steps

設定値:25

項目:Width × Height

設定値:1024 × 1024

項目:CFG Scale

設定値:6

項目:Seed

設定値:-1(ランダム)

CheckpointモデルとVAEの設定、プロンプトを入力とパラメーター設定が出来たら、画面の右上にあるオレンジ色の「Generate」ボタンをクリック して、生成結果を確認しましょう!

⚠️ 生成結果に乱れが生じている場合

もし以下の様な、描画の乱れが発生した場合はそれぞれ対処方方法がありますので

後の節の解説にて、それぞれ詳しく解説していきます。

- 顔や手が崩れている → Adetailerを有効化

- 構図がズレている → プロンプトの順序を変更(重要な要素を先頭に)

- 画風が違う → anime style を realistic や illustration に変更

- 全体的にぼやけている → Sampling stepsを30に増やす

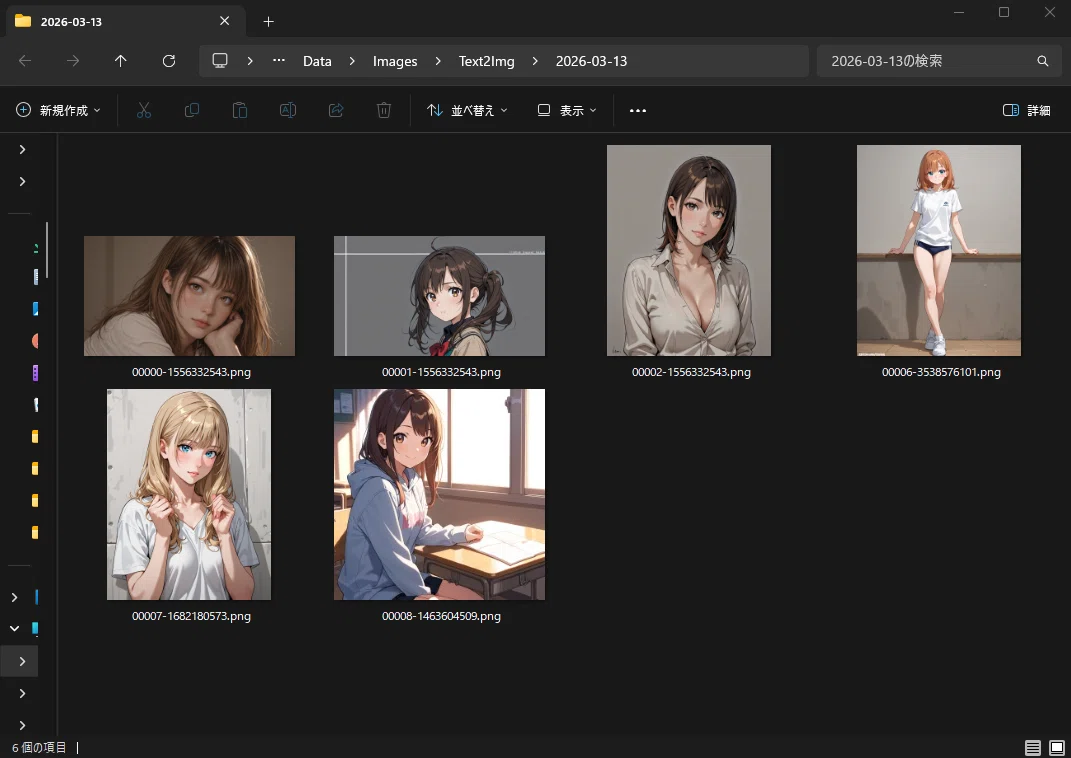

生成結果の保存場所

生成した画像は自動的に保存されますが、ローカル環境とクラウド環境では保存先が異なります。「せっかく生成したのにどこに保存されたか分からない」という事態を防ぐために、

あらかじめ保存先を確認しておきましょう。

ローカル環境の画像の保存方法

ローカル環境(Stability Matrix + Forge)では、生成した画像は以下のパスに自動保存されます。

ローカル環境(Stability Matrix + Forge)

Data/Packages/stable-diffusion-webui-forge/outputs/txt2img-images/[日付フォルダ]/

方法1:WebUI上で保存

- 生成画像を右クリック

- 「名前を付けて画像を保存」 を選択

方法2:フォルダから取得

- 画像下の 「フォルダアイコン」 をクリック

- エクスプローラー(Finderまたはファイルブラウザ)が開く

ウィンドウが開かない場合はタスクバーのエクスプローラーを確認して下さい。 - 画像ファイル(.png)をコピー

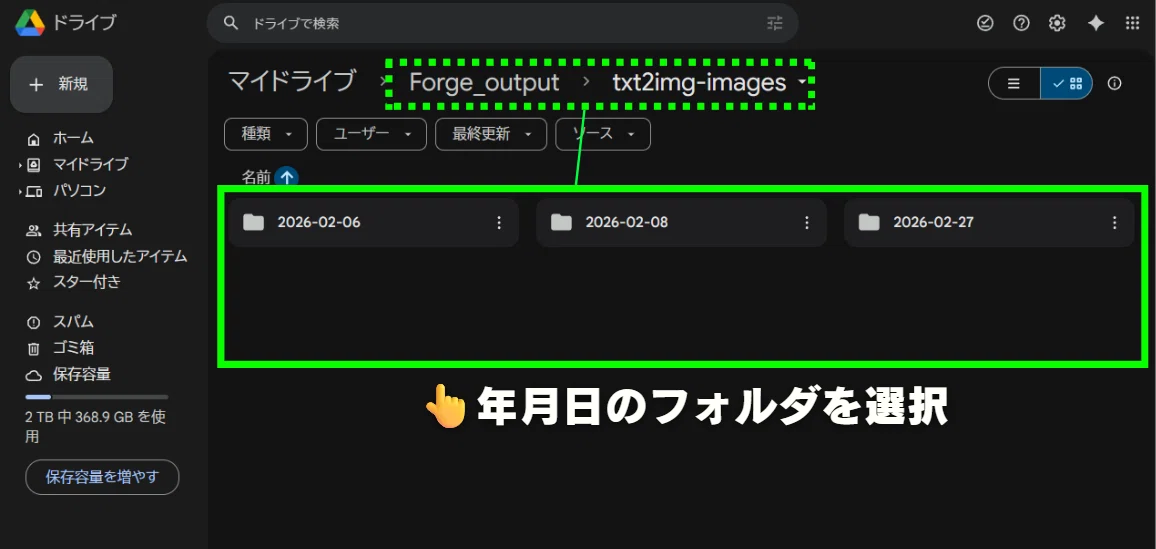

クラウド環境の画像の保存方法

Google Colabで生成した画像は、GoogleDrive連携の有無によって保存先が変わります。

セッション終了時に消えてしまう場所と、永続保存される場所の違いをしっかり覚えておいてください。

クラウド環境(Google Colab)※GoogleDrive 連携あり(ざすこ式)

ざすこ式Notebookで環境構築をしてGoogle Driveに保存する設定をしている場合は

(/content/drive/MyDrive/Forge_outputs/)に自動的に保存されるように設定されています。

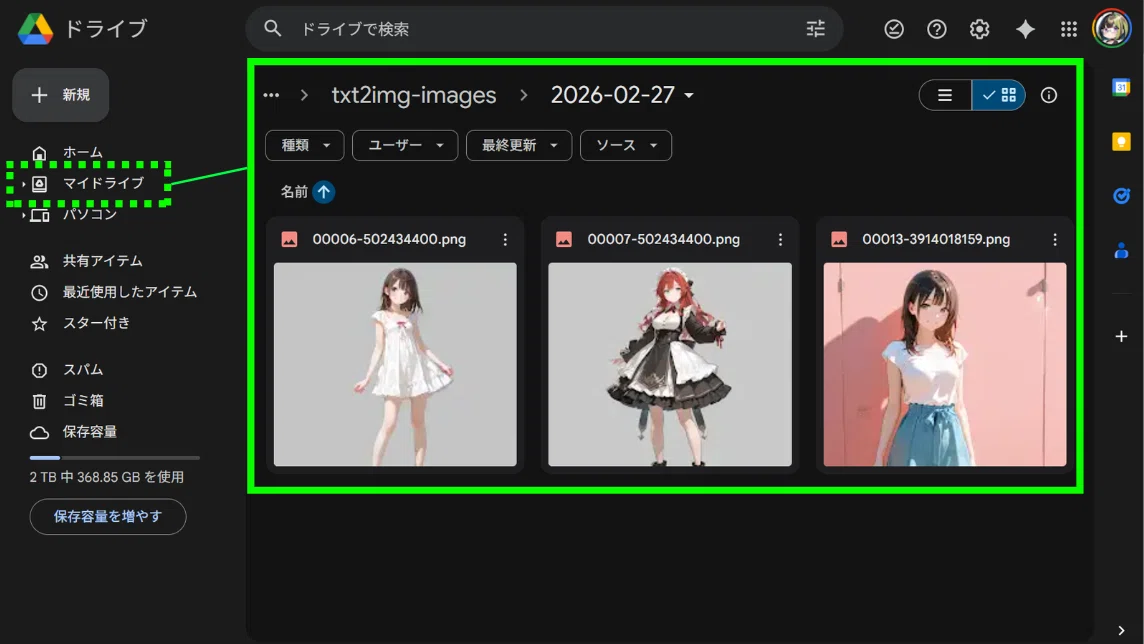

- 生成後、GoogleDrive_内のマイドライブ内の「Forge_output」フォルダ を開く

- 「txt2img-images」フォルダ内の日付別フォルダの中を確認

- 画像を右クリック → 「ダウンロード」 でローカルに保存

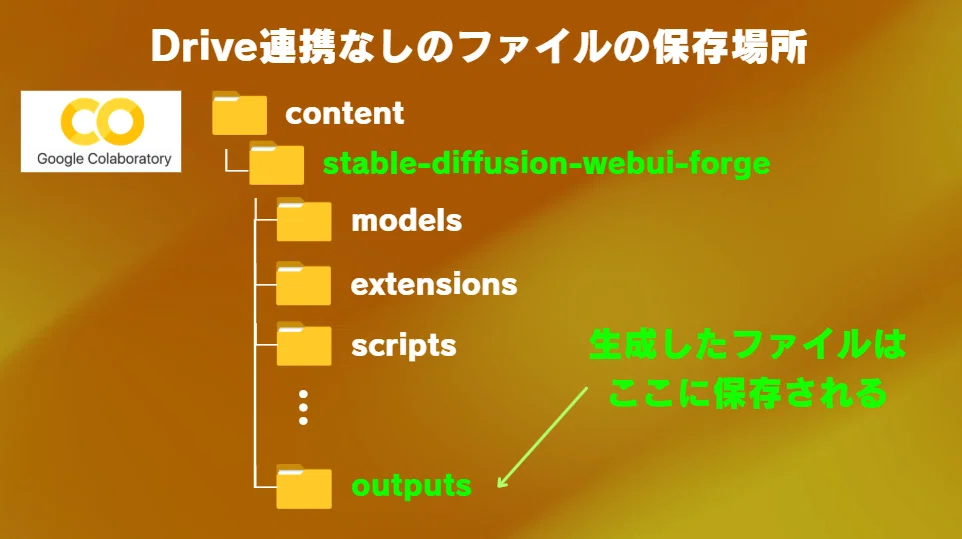

クラウド環境(Google Colab)※GoogleDrive 連携なし

Google Driveに保存する設定をしている場合は

(/content/stable-diffusion-webui-forge/outputs/txt2img-images/)に自動的に保存されます。

- 生成後、Colab画面左側の 「フォルダアイコン」 をクリック

- /content/stable-diffusion-webui-forge/outputs/txt2img-images/ を開く

- 画像を右クリック → 「ダウンロード」 で保存

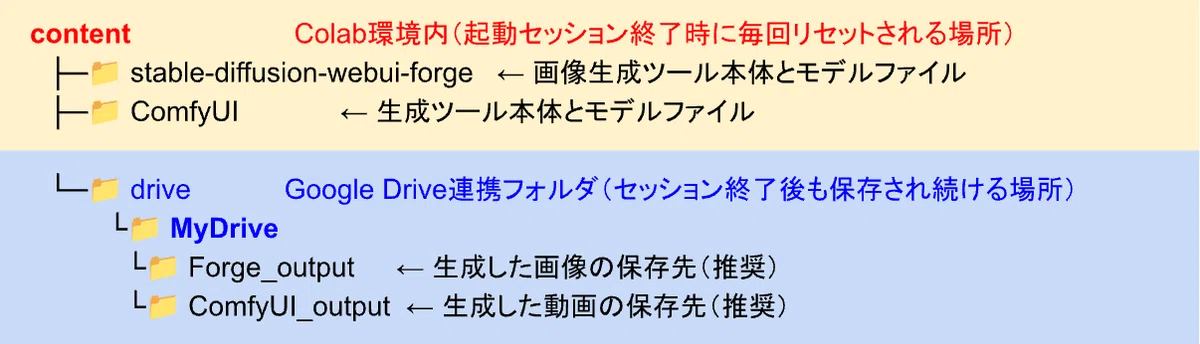

フォルダ構成:「content」と「MyDrive」の違い(ざすこ式Notebook)

GoogleDriveと接続させたGoogle Colabは、大きく分けて2つの場所にフォルダが作られます。

この違いを理解しておくと、ファイルの保存先で迷いにくくなります。

2つの場所の違い

content/ :

特徴 Colab環境内、高速だが一時的

セッション終了後 消える(次回起動時に再構築)

MyDrive/ :

特徴 Google Drive内、永続保存

セッション終了後 残る(ファイルがずっと保存される)

必ず入れたい便利な拡張機能

さて、ここまで環境構築した Forge WebUI 、もちろんこのままでも使用可能なのですが、

実は、より快適に生成作業を行うために、様々な「拡張機能」が用意されているんです。

この拡張機能を追加することで、作業効率や使い心地が格段に上がりますので、ここでは初心者のうちから入れておくと便利なおすすめ拡張機能を3つ紹介します。

---

この記事の続きはこちら https://www.aicu.jp/post/260513

Originally published at note.com/aicu on May 13, 2026.

Comments