2025年9月19日に開催されたComfyUIの公式ストリームでは、ゲストにビデオアーティストのTrent Hunter氏(Flipping Sigmas)を迎え、新登場のAIビデオ生成モデル「WAN Animate」の徹底解説とライブデモンストレーションが行われました 。既存のVACEモデルとの比較を通じて、被写体と動きを分離して処理する新しいアプローチや、低VRAMでの高解像度生成を可能にする卓越した効率性が明らかにされました 。ストリームでは最新の「Wan 2.2 Animate」について、Kajai氏が開発したカスタムノードを用いた具体的なワークフローのセットアップ方法が紹介されたほか、視聴者からのアドバイスを元にリアルタイムで問題を解決するなど、オープンソースコミュニティの協力的な文化を象徴する活気ある内容となりました 。

チャプター1: オープニングとゲスト紹介

司会者: 「ハロー、皆さん。ComfyOrgのストリームへようこそ。」

この日のストリームでは、司会者 Purz (X@PurzBeats) のもと、Fill と、ゲストとして「Flipping Sigmas」としても知られるTrent Hunter氏 (X@FlippingSigmas) が参加しました。

Trent氏は自己紹介で、もともと「Warp Fusion」からAIビデオ制作の世界に入り、その後ComfyUIに完全に夢中になったと語りました。彼の作品が映画会社の目に留まり、それが現在の本業に繋がったとのことです。AIにのめり込むきっかけは、MidJourneyでテキストから画像が生成された瞬間に、「これはすぐにビデオになる」と直感したことだったと振り返りました。

チャプター2: オープンソースコミュニティの力

Trent: 「このコミュニティの力は、誰もがお互いの功績の上に(新しいものを)築き上げていけることにあると思います。」

ストリームでは、ComfyUIを取り巻くオープンソースコミュニティの文化についても語られました。Trent氏は、過去にセットアップで困っていた際、見知らぬ人が30分も時間を割いて助けてくれた体験談を披露し、人々が助け合うコミュニティの素晴らしさを強調しました。

司会者もこれに同意し、「誰かが何かを発見したら、それを独り占めせずにすぐに共有する。それがこのコミュニティの最大の強みです」と述べました。この共有の精神が、技術の急速な発展を支えているという点で、参加者の意見は一致しました。

チャプター3: コミュニティチャレンジの発表

司会者: 「先週のコミュニティチャレンジは、提供されたソースビデオからポーズをコントロールしたビデオを作成する、というものでした。」

先週開催されたコミュニティチャレンジの結果が、コミュニティ責任者のJoe氏が編集した素晴らしいモンタージュビデオと共に発表されました。参加者たちのハイレベルな作品に、一同は感嘆の声を上げました。

Comfy Challenge #4 Montage "Pose Alchemy"

Comfy Challenge #4 Montage

— ComfyUI (@ComfyUI) September 18, 2025

"Pose Alchemy"

Using the provided reference poses to control character dynamics.

Here are dozens of highlight videos from our community and check the recommended workflow on how to do it 👇 pic.twitter.com/xoKiqVTvz1

深掘りレポート:WAN AnimateとVACEモデルの比較議論

作品の講評に関連して、Fill氏による WAN AnimateとVACE Fun model を比較する議論がありました。この議論は、AIビデオ生成技術がいかに驚異的なスピードで進化しているかを象徴する場面から始まります。

コミュニティチャレンジで発表された、ポーズコントロール技術を駆使した素晴らしい作品群に対し、チャットから「Juan Anime(WAN Animate)はこれを破壊する(凌駕する)」というコメントが寄せられました。

これを受け、司会者は「この技術は発表されてまだ1週間なんですよ」と笑いながら述べ、先週の時点では最先端だったものが、新しいモデルの登場によって一瞬で過去のものになるという、この分野の異常な開発速度を指摘しました。技術の陳腐化と進化のスピードの速さです。このやり取りは、これから解説されるWAN Animateが、既存の技術からいかに大きな飛躍を遂げたかを示唆する導入となっています。

視聴者から「WAN Animateと既存モデルとの違いは何か?」という質問が寄せられたことをきっかけに、より技術的な比較へと話が進みます。

共通点として両モデルは、最終的な目的においては非常に似ています。どちらも、

-

キャラクターの参照画像

-

ポーズを制御するための情報(深度マップ、Cannyエッジ、OpenPoseなど)

これらを入力として、キャラクターが一貫性を保ったまま動くビデオを生成します。

相違点は、その目的地に至るまでのアプローチ、つまり内部的な仕組みが異なると解説されています。

-

異なる学習方法: 根本的な違いは、学習に使われたデータセットやモデルのトレーニング方法にあると推測されています。

-

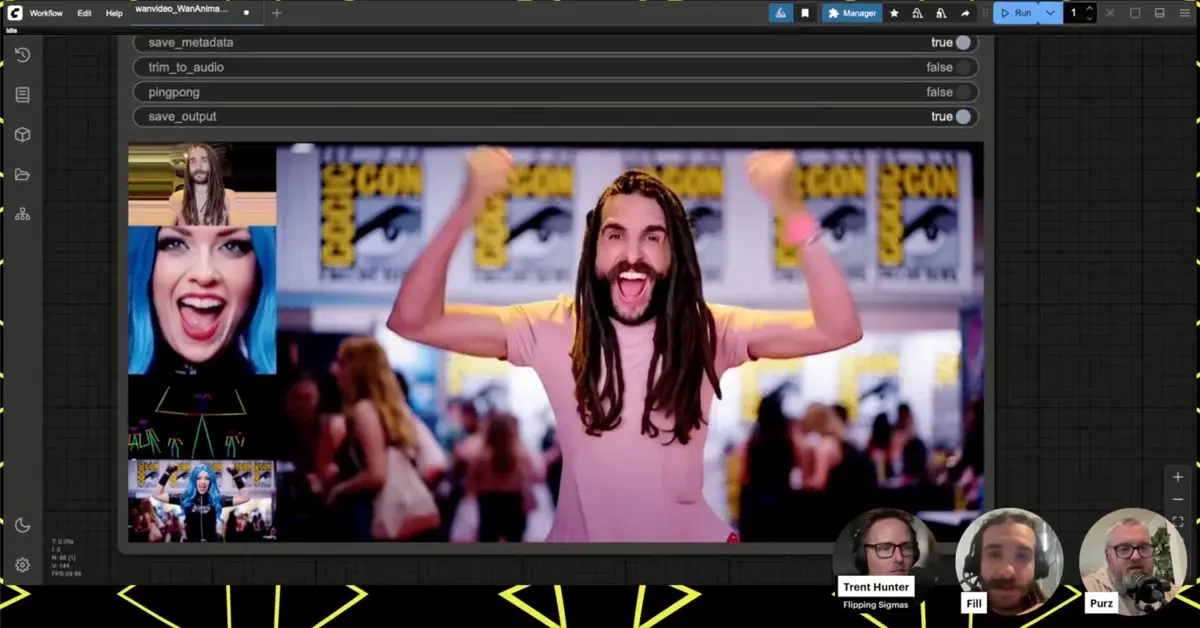

「被写体」と「動き」の処理: 最も重要な違いとして、WAN Animateは「被写体(subject)」と「動き(movement)」をVACEとは少し異なる方法で処理する点が挙げられました。これは、WAN Animateが単にスタイルを適用するだけでなく、ビデオ内の被写体をより明確に認識し、参照画像のキャラクターと精密に「置き換える」能力に長けていることを示唆しています。

-

「Mixモード」の存在: 司会者が特に注目しているのが、Kajai氏のカスタムノード(KJ nodes)と連携して機能するWAN Animateの「Mixモード」です。これは「非常に特別なものになる」と大きな期待が寄せられており、後のデモンストレーションで示される高度な被写体置換機能の核となる部分です。

効率性の革命:低VRAMでの高解像度生成。議論の中で、WAN Animateのもう一つの大きな利点として、卓越したVRAM効率が挙げられました。司会者は、先行アクセスで試した際に1280x720という高解像度にもかかわらず、使用VRAMが20GB未満だったと報告しています。これは、これまでハイエンドなGPUでしか不可能だった高品質なビデオ生成が、より一般的な環境でも実現可能になることを意味し、コミュニティにとって非常にエキサイティングな進歩と言えます。

続いて、今週の新しいチャレンジとして「一人称視点のフライト」がテーマであることが発表されました。要件は以下の通りです。

-

テーマ: 一人称視点の飛行シーン

-

アスペクト比: 1x1(正方形にクロップされることを想定)

-

長さ: 20秒未満

-

賞品: 100ドルの現金、または200ドル相当のComfyUIクレジット

-

締切: 9月22日午後7時(太平洋時間)

🪽Comfy Challenge #5: "Infinite Flight"

— ComfyUI (@ComfyUI) September 18, 2025

First-person Flying Scenes

We'll be looking for creativity in the scene and story, along with smooth, high-quality motion!

🏆 $100 cash or $200 ComfyUI credits

Let's fly in daydreams together! pic.twitter.com/O1RosSrROb

チャプター4: WAN Animateワークフローの解説

司会者: 「さあ、皆さんお待ちかねの、今日のメインテーマに移りましょう。このワークフローはどこにあるんだ?送ってくれ!と聞かれる前に言っておきますね。」

—

この記事の続きはこちらから https://note.com/aicu/n/n4fba227572e7

Originally published at note.com/aicu on Sep 20, 2025.

Comments